Seedream 4.0阅读总结中文翻译

一、总结

效果特点

可生成原生高分辨率图像(1k - 4k)

可应用于专业场景:图表、公式和设计素材生成

速度

在不使用 LLM/VLM 作为 PE 模型的前提下,生成一张 2K 图像的推理时间最短可达 1.4 秒

数据

指出了seedream 3.0数据的问题:

整体分布太偏向于自然图像

低估了细粒度、以知识为中心的概念(例如,教学内容和数学表达式)

针对知识数据(包括教学图像和公式)进行优化:

来源

自然数据(natural)

从公司内部教材、研究论文和小说的PDF文档中收集高质量的图表

低质分类器:滤掉不理想的样本(例如模糊的图像、杂乱或噪声背景的图像)

难度分类器:将样本进行难易分类,对于较难的样本进行在预训练时进行down-sampled,也就是采样概率减小

合成数据(synthetic)

利用OCR输出结果和LaTeX源代码(如有)去生成结构(布局、符号密度)和分辨率各不相同的多样化公式图像

量级

数十亿文本-图像对

涵盖多种分类体系和知识导向概念

分辨率

图像原生分辨率覆盖 1K 到 4K

数据处理模块升级

文本质量分类器:用于检测原始caption中的低质量文本

去重:去重流程中结合了语义和低层级视觉嵌入,以提升去重效果,并平衡细粒度分布

优化caption生成模型:以实现更细粒度的视觉描述;

采用更强的跨模态嵌入进行图像-文本对齐:显著提升了我们的多模态检索引擎

网络结构

VAE

具有极高压缩比,显著减少image token数量

DiT

新的高效可扩展的DiT主干网络,其他没说

训练方式

预训练

多阶段训练

阶段1:平均分辨率为 512²(具有不同宽高比)的情况下训练我们的 DiT;

阶段2:在从 1024² 到 4096² 的更高分辨率下微调模型

后训练

在预训练的DiT模型上对多个任务进行多模态联合微调,包括文本到图像生成(T2I)、单图像编辑以及多图像参考与输出

持续训练(CT)

CT阶段主要提升了图像编辑中的指令遵循能力

微调SFT

SFT阶段则显著提高了参考图像与编辑后图像之间的一致性。

人类反馈对齐(RLHF)

提示工程(PE)模型训练

基于 Seed1.5-VL [6] 训练了一个端到端的视觉语言模型(VLM)作为 PE 模型。

该 VLM 模型处理用户输入,包括文本提示、单张参考图像或多张图像,并生成相应的输出(例如,参考图像和目标或预测图像的描述,如 SeedEdit 3.0 [20] 所做),这些输出随后作为输入传递给 DiT 模型。

PE 模型的功能还包括任务路由、提示重写(带自动思考)以及最优长宽比估计。

二、中文翻译

摘要

我们提出了 Seedream 4.0,这是一个高效且高性能的多模态图像生成系统,能够在单一框架内统一文本到图像(T2I)合成、图像编辑以及多图像构图功能。我们开发了一种高效的扩散 Transformer 模型,搭配功能强大的 VAE,可显著减少图像标记(image tokens)的数量。这使得模型训练更加高效,并能够快速生成原生高分辨率图像(例如 1K-4K)。Seedream 4.0 在涵盖多种分类体系和知识导向概念的数十亿文本-图像对上进行了预训练。通过横跨数百个垂直场景的全面数据收集,结合优化策略,确保了稳定且大规模的训练过程,并具备强大的泛化能力。通过引入经过精心微调的 VLM 模型,我们执行多模态后训练,联合训练 T2I 与图像编辑任务。为加速推理,我们融合了对抗性蒸馏、分布匹配、量化技术以及推测性解码(speculative decoding)。在不使用 LLM/VLM 作为 PE 模型的前提下,生成一张 2K 图像的推理时间最短可达 1.4 秒。综合评估表明,Seedream 4.0 在 T2I 和多模态图像编辑任务上均达到当前最优水平。特别是,在复杂任务中展现出卓越的多模态能力,包括精确的图像编辑与上下文推理,并支持多图像参考,可生成多张输出图像。这将传统的 T2I 系统拓展为更具交互性与多维性的创作工具,推动生成式 AI 在创意与专业应用领域的边界。Seedream 4.0 现已可在火山引擎上访问。

1 引言

扩散模型为生成式人工智能开启了新的时代,实现了图像合成在逼真度和多样性上的显著提升。基于扩散变换器(DiTs)的最新进展,涌现出一系列顶尖的开源与商业系统,例如 Stable Diffusion [18]、FLUX 系列 [7, 8]、Seedream 模型 [3, 4, 21]、GPT-4o 图像生成 [15] 以及 Gemini 2.5 flash [5]。然而,随着对更高图像质量、更强可控性以及强大多模态能力(例如文本到图像(T2I)合成和图像编辑)的需求不断增加,当前模型往往面临关键的可扩展性瓶颈。

在本文中,我们介绍了 Seedream 4.0,这是一个为可扩展性和高效性而设计的强大多模态生成模型。我们开发了一种高效且可扩展的 DiT 主干网络,显著提升了模型容量,同时大幅降低了训练和推理的 FLOPs。为进一步提升模型效率,尤其是在高分辨率图像生成方面,我们设计了一种高效的变分自编码器(VAE),具有极高的压缩比,显著减少了潜在空间中的图像标记数量。这种架构设计(包括我们的 DiT 和 VAE)使我们的模型在训练和推理过程中均具备高度效率、易于扩展且对硬件友好。我们的训练策略经过精心设计,充分挖掘了架构的全部潜力,相较于 Seedream 3.0 [3] 实现了超过 10 倍的推理加速,同时性能显著更优。这使得模型能够在数以十亿计的文本-图像对上有效训练,图像原生分辨率覆盖 1K 到 4K,涵盖广泛的分类体系和以知识为中心的概念。

在后训练阶段,我们将一个具备强大多模态输入理解能力的视觉语言模型(Vision-Language Models, VLM)整合进我们的系统中,如SeedEdit [21] 所设计,从而赋予其强大的多模态生成能力。我们首次提出一种联合后训练方法,通过DiT框架中设计的因果扩散机制(causal diffusion),同时实现文本到图像生成与图像编辑。我们的后训练阶段首先从持续训练(Continuing Training,CT)开始,以拓宽模型的基础知识和多任务能力。随后进行监督微调(SFT),以培养特定的艺术风格特征。接着,我们实施基于人类反馈的强化学习(RLHF),以精确对齐模型输出与细腻的人类偏好。随后,我们开发了一个提示工程(PE)模块,以充分释放模型在多样化用户输入下的全部潜力。为了在我们的DiT上实现超高速推理,我们提出了一套以对抗性学习框架为核心的综合加速系统。这一核心算法创新与面向硬件的量化技术及推测解码技术协同配合,最终构建出一个在不损失质量的前提下,实现秒级生成体验的系统。

综上所述,Seedream 4.0 具有以下优势:

• 高效且可扩展的架构。 我们的模型包含经过精心设计的DiT架构以及一个强大的VAE,同时具备较高的压缩比。这使得该架构具有极高的效率,相较于Seedream 3.0 [3],在训练和推理速度上实现了超过10倍的加速(以计算浮点运算量衡量),且性能显著更优。Seedream 4.0的高效架构使其在模态容量、任务覆盖范围以及多模态泛化能力方面均展现出强大的可扩展性。

• 强大的多模态生成能力。我们扩展了Seededit 3.0 [20] 架构以实现多模态生成,并在预训练的DiT模型上对T2I和图像编辑任务进行多模态联合微调。这使得Seedream 4.0具备强大的多模态能力,支持单图或多图输入与输出。

• 专业创作场景。 除了艺术图像之外,Seedream 4.0 还展现出生成结构化、专业化和知识型内容的强大能力,例如图表、公式和设计素材,弥合了创意生成与实际产业应用之间的差距。

• 超快推理速度。 通过高效的架构设计,我们进一步对框架进行激进优化,以实现极致的推理加速。这使得我们的模型能够在高分辨率(例如 2K 或 4K)下实现超快速的图像生成与编辑,极大地提升了用户体验和生产效率。

Seedream 4.0 已成功集成到多个平台,包括 Doubao 和 Jimeng,截至 2025年9月。也可在火山引擎α上访问。我们相信,Seedream 4.0 将成为提升工作和日常生活中各个方面生产力的实用工具。

2 数据、模型训练与加速

2.1 模型预训练

数据。 在 Seedream 3.0 中,我们引入了一种双轴协同数据采样框架,该框架在视觉形态和语义分布两个维度上联合优化预训练数据。然而,在应用纯自上而下的重采样策略时,我们观察到两个局限性:

• 在总体分布中过度倾向于自然图像。

• 它低估了细粒度、以知识为中心的概念(例如,教学内容和数学表达式)。

为解决这些问题,我们针对知识相关数据(包括教学图像和公式)重新设计了该流程。

在我们的流程中,知识数据被划分为自然数据(natural)和合成数据(synthetic)两个子集。对于自然图像,我们从公司内部教材、研究论文和小说的PDF文档中收集高质量的图表。我们首先部署一个低质量分类器,以过滤掉不理想的样本(例如模糊的图像、杂乱或噪声背景的图像)。随后,我们训练一个具有三个等级的难度评分分类器:简单、中等和困难,并相应地对所有图像进行标注。在预训练过程中,难度极高的图像会被减小采样的概率。对于合成数据,我们利用OCR输出结果和LaTeX源代码(如有)去生成结构(布局、符号密度)和分辨率各不相同的多样化公式图像。这种合成策略扩展了细粒度概念的覆盖范围,并缓解了自上而下重采样引入的偏差。

除了与知识相关的数据外,我们相较于之前的版本引入了多个模块级别的升级。(1) 我们训练了一个文本质量分类器,用于检测原始caption中的低质量文本;(2) 我们在去重流程中结合了语义和低层级视觉嵌入,以提升去重效果,并平衡细粒度分布;(3) 我们优化了caption生成模型,以实现更细粒度的视觉描述;(4) 我们采用更强的跨模态嵌入进行图像-文本对齐,显著提升了我们的多模态检索引擎。

训练策略。 与 Seedream 3.0 [3] 类似,我们采用多阶段训练以提高训练效率。在第一阶段,我们在平均分辨率为 512²(具有不同宽高比)的情况下训练我们的 DiT。在第二阶段,我们在从 1024² 到 4096² 的更高分辨率下微调模型。得益于我们模型的高效设计,即使在高达 4K 的分辨率下进行训练依然有效。

训练基础设施。 为实现DiT模型的大规模高效预训练,我们设计了一套高度优化的训练系统,该系统注重硬件效率、可扩展性和鲁棒性。其关键组件总结如下。

并行性与内存优化

我们采用混合分片数据并行(HSDP)来高效地分片权重,并在不使用张量并行或专家并行的情况下支持大规模训练。通过及时释放隐藏状态、激活值卸载以及增强的FSDP支持,优化了内存使用,使得在可用GPU资源内训练大型模型成为可能。

内核与工作负载优化

通过结合 torch.compile 与手工编写的 CUDA 内核及算子融合,加速性能关键操作,减少冗余内存访问。为解决因序列长度可变导致的工作负载不均衡问题,我们引入了一种全局贪心样本分配策略与异步流水线,实现了更均衡的每 GPU 利用率。

容错性

系统内嵌了多级容错机制,包括模型、优化器和数据加载器状态的周期性检查点保存、启动前的健康检查以排除故障节点,以及降低的初始化开销。这些措施确保了长时间分布式训练过程中的稳定性和持续吞吐量。

2.2 模型后训练

我们对模型进行了密集的后训练,以增强其多模态能力,包括文本到图像生成(T2I)、单图像编辑以及多图像参考与输出。具体而言,我们通过多阶段后训练对多个任务进行联合训练,包含持续训练(CT)、监督微调(SFT)以及人类反馈对齐(RLHF)[11, 23–25];同时,还开发了一个经过精心调优的提示工程(PE)模型。在每个子阶段,性能均得到持续且显著的提升,使得整体性能优于仅针对单一任务训练的模型。特别是,CT阶段主要提升了图像编辑中的指令遵循能力,而SFT阶段则显著提高了参考图像与编辑后图像之间的一致性。

我们构建了大量用于CT和SFT阶段的编辑数据。每个数据样本通常包含一张参考图像和一张目标图像,以及一条编辑指令。为参考图像和目标图像分别生成图像描述。我们设计了三种不同细节程度的描述,作为训练期间的数据增强形式。此外,我们鼓励在描述中使用一致的术语来描述参考图像与目标图像之间的相似性。

我们基于 Seed1.5-VL [6] 训练了一个端到端的视觉语言模型(VLM)作为我们的 PE 模型。该 VLM 模型处理用户输入,包括文本提示、单张参考图像或多张图像,并生成相应的输出(例如,参考图像和目标或预测图像的描述,如 SeedEdit 3.0 [20] 所做),这些输出随后作为输入传递给 DiT 模型。PE 模型的功能还包括任务路由、提示重写(带自动思考)以及最优长宽比估计。为平衡延迟与性能,我们的模型基于任务复杂度动态调整其思考预算,这一设计灵感来自 AdaCoT [12]。这种集成方法使 Seedream 4.0 能够更好地理解用户意图,执行复杂推理,并从单一请求生成一系列图像。

2.3 模型加速

高效、高质量的合成。我们的加速框架整合了Hyper-SD [17]、RayFlow [19]、APT [10]和ADM [13]的原理,以加速扩散变压器(DiTs)。我们的方法建立了一种创新的范式,其中每个样本遵循一个优化的自适应轨迹,而不是共同的路径到达高斯先验。这种定制化减少了轨迹重叠并降低了不稳定性。为了有效学习这些路径,我们采用了一种对抗匹配框架,替代了固定的散度度量,从而避免模式崩溃并显著提高生成稳定性和样本多样性。这是通过一个两阶段过程实现的,首先是一个稳健的对抗蒸馏后训练(Adversarial Distillation post-training,ADP)阶段,使用混合判别器以确保稳定的初始化。随后,对抗分布匹配(Adversarial Distribution

Matching, ADM)框架采用可学习的、基于扩散的判别器进行微调,从而实现对复杂分布的更细致匹配。我们的统一的pipeline能够实现高度高效的少步采样,大幅减少功能评估次数(NFE),同时在美学质量、图文一致性和结构保真度等关键维度上达到或超越需要数十步的基础方法,有效地平衡了质量、效率和多样性。

量化。 为了在不损失质量的情况下进一步提升推理性能,我们采用了一种面向硬件的框架,结合了量化与稀疏性。我们的方法使用自适应的4/8位混合量化,包括离线平滑处理以应对异常值,基于搜索的优化以确定敏感层的最佳粒度和缩放系数,以及训练后量化(PTQ)以最终确定参数。我们还针对不同位宽和粒度,协同设计了高效且面向硬件的专用算子,以最大化性能。

PE的推测解码。 我们的方法基于Hyper-Bagel[14]的奠基性工作,以解决推测解码中因随机采样token而产生的固有不确定性。我们的解决方案将特征预测条件同时建立在先前的特征序列以及向前推进一个时间步长的token序列之上。这提供了一个确定性的目标,以消除采样歧义,并显著提升预测准确性。我们进一步通过在Key-Value(KV)缓存上引入损失函数,以在推理过程中实现高效重用,并在logits上引入辅助交叉熵损失,以优化草稿模型。

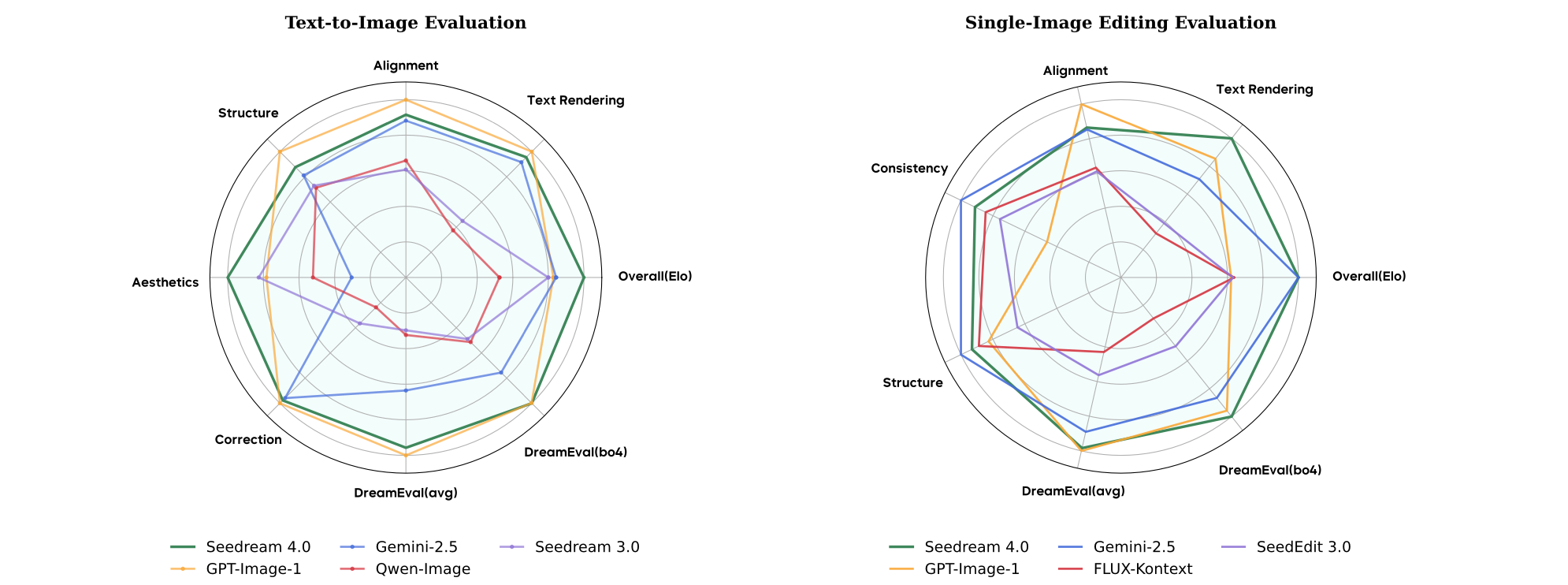

3 模型性能

在本节中,我们对Seedream 4.0进行了全面评估。首先,我们报告了来自公开平台Artificial Analysis Arena [1]的整体ELO评分结果,如图3所示。Artificial Analysis Arena通过维持一个实时竞技场,持续整合新发布的模型,并提供动态排行榜。参与评测的模型包括Seedream系列(Seedream 3.0 [3]、Seedream 4.

为了进一步探讨 Seedream 4.0 的细粒度能力,我们提供了人工评估和自动基准测试结果。在各种任务和维度上,Seedream 4.0 均表现出卓越的性能。最后,我们强调了其出色的多模态图像生成能力。通过灵活组合输入和输出模态,Seedream 4.0 可支持广泛的创意应用。我们还展示了这些功能的示

3.1 综合人类评估

为了将 Seedream 4.0 的性能与其他顶级图像生成模型进行对比,我们构建了一个全面的多模态基准测试集 MagicBench 4.0。该基准测试涵盖了三大任务类别:文本到图像(T2I)生成、单图编辑以及多图编辑。这三个赛道分别包含 325 个提示、300 个提示和 100 个提示;每个提示均提供中文和英文两种版本。在以下章节中,我们将对各类模型在这些任务中的表现进行详细分析。

3.1.1 Text-to-Image

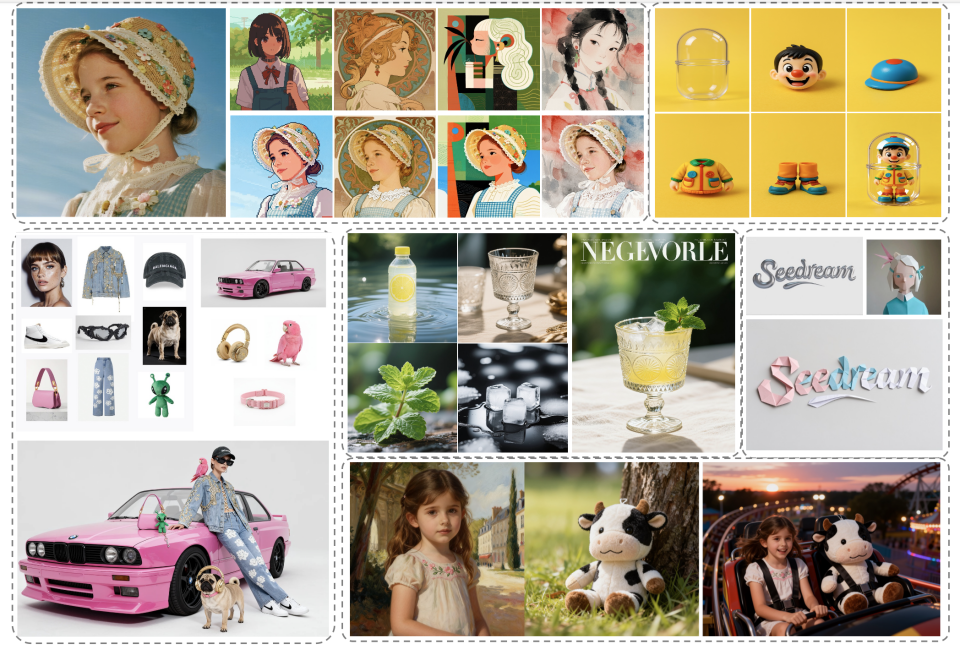

作为图像生成模型的基础能力,T2I生成始终是Seedream系列的重点关注方向。除了传统的评价维度,如提示对齐、结构稳定性和视觉美感之外,我们还从两个额外方面评估了模型性能:密集文本渲染和内容理解。后者尤其适用于需要高级上下文推理或特定领域知识的提示。如图1所示,与前代模型相比,Seedream 4.0 以其卓越的视觉冲击力脱颖而出,包括动态的运动感、自然的光照以及连贯的色彩搭配。

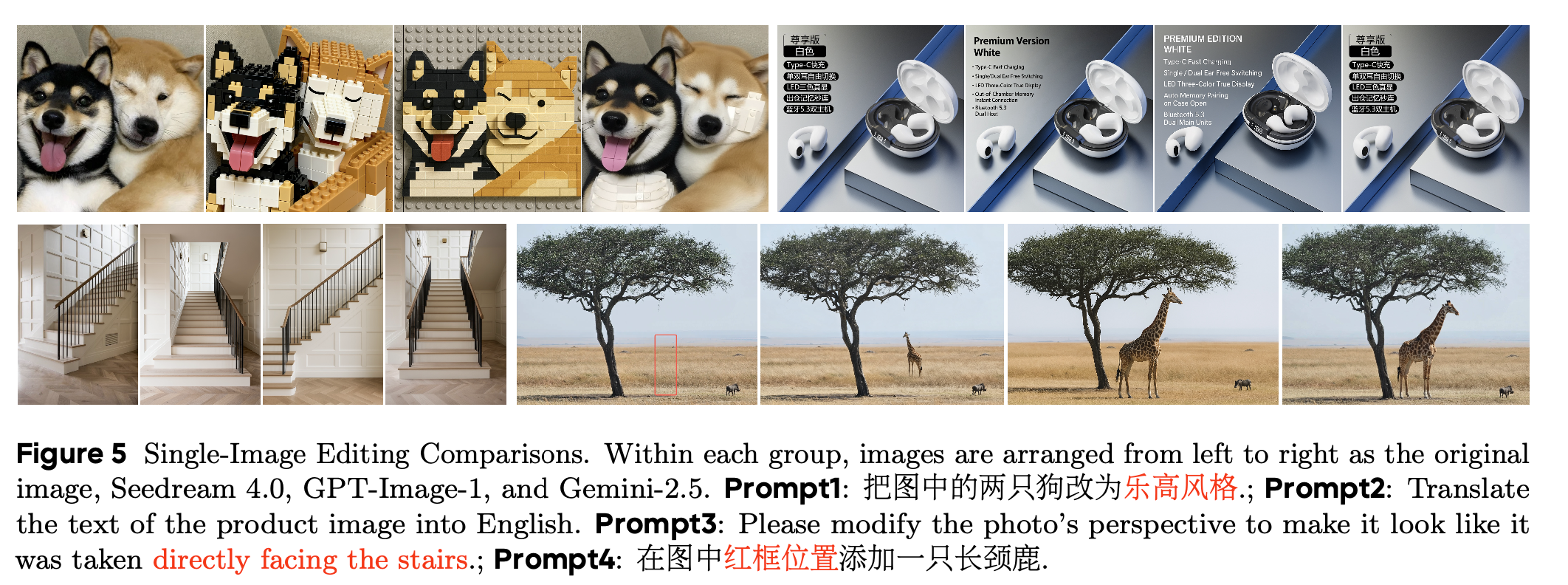

3.1.2 单图编辑

图5 单图编辑对比。每组中,图像从左至右依次为原始图像、Seedream 4.0、GPT-Image-1 和 Gemini-2.5。

Prompt1 : 将图中的两只狗改为乐高风格。

Prompt2 : 将产品图像中的文字翻译成英文。

Prompt3 : 请调整照片的视角,使其看起来像是正对楼梯拍摄的。

Prompt4 : 在图中红框位置添加一只长颈鹿。

Seedream 4.0 在统一的流程中集成了编辑与生成能力,使二者相互促进,性能超越了前代版本 SeedEdit 3.0。图像编辑中的一个关键挑战在于指令遵循与一致性之间的权衡,这也是我们评估的重点。此外,我们还考虑了结构完整性和文本编辑性能。如图 1 所示,各领先模型的结果呈现出显著不同的模式。GPT-Image-1 在指令遵循方面达到最高准确率,但在一致性方面排名最低,这一局限性已被广泛指出。相比之下,Gemini-2.5 在保持原图特征方面表现优异,但在指令遵循方面能力有限,尤其在风格迁移和视角变换等任务上表现不佳,如图 5 所示;同时在文本编辑方面也存在困难,尤其是在中文文本编辑方面。相比之下,Seedream 4.0 在所有维度上均展现出更为均衡的性能。它支持广泛的编辑任务,保持了较强的

第9页

一致性,从而实现了更高的实际可用性。

3.1.3 多图编辑

图6 多图编辑对比。左图:整体评估结果。右图:两个示例,虚线框表示输入参考图,输出结果从左到右依次为Seedream 4.0、GPT-Image-1和Gemini-2.5。在最右侧示例中,右上角图像来自Seedream 4.0。提示1:参照第二张图片中的色卡,将房间及所有家具转换为多巴胺风格;提示2:将第一张图片中的物品放置在柜子的上层搁架上。将第二张图片中的物品放置在柜子的中层搁架上。将第三张图片中的物品放置在柜子的底层搁架上。

多图编辑超越了多幅图像的简单组合,它要求模型能够对不同输入中的物体进行丰富的上下文理解。我们采用包含三个客观维度(指令对齐度、一致性与结构)的综合指标(GSB)对比了Seedream 4.0、GPT-Image-1和Gemini-2.5的表现。如图6所示,结果与单图编辑一致:GPT-Image-1在指令响应性方面表现突出,但一致性较弱;而Gemini-2.5在结构保留方面表现优异,但在响应性上有所欠缺。相比之下,Seedream 4.0在所有维度上均达到最高水平,在GSB指标上比另外两个模型高出近20%。多图编辑中的一个关键考量是结构完整性。我们观察到,随着参考图像数量的增加,其他模型的输出往往会出现结构退化现象。然而,Seedream 4.0能够保持更加稳定和连贯的结构,即使在提供超过十张参考图像的情况下,仍展现出强大的鲁棒性。

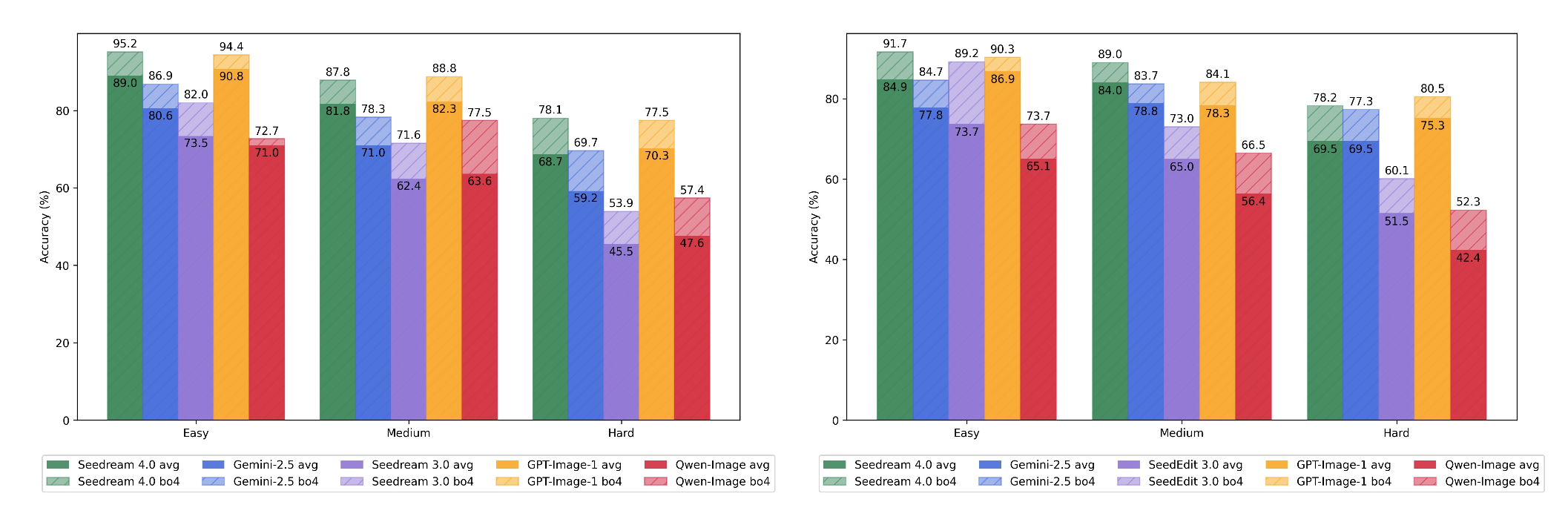

3.2 基于 DreamEval 的自动评估

图7 使用DreamEval的自动评估。左:文本到图像;右:单图像编辑。

自动评估是模型评估中不可或缺的组成部分,因为它能够实现大规模测试,并相较于完全依赖人工评估,提供更稳定、更迅速的反馈。我们提出了 DreamEval,一个全面的多模态基准,包含四种生成场景,涵盖 128 个子任务,其中

图8 精确编辑的示例。

1,600 个提示。评分过程针对每个提示分解为细粒度的视觉问答,使评估更易于解释且具有确定性。特别是,DreamEval 还引入了分层难度级别,分别评估基础生成技能、高级生成能力以及高阶理解与推理能力。

指令遵循的总体结果如图1和图6所示,结果与人工评估高度一致。图6展示了T2I任务和单图编辑任务在三个难度等级下的详细性能表现。可得出以下几点观察:(1)Seedream 4.0和GPT-4o在指令遵循方面优于其他模型,尽管Seedream 4.0表现出更大的波动性:其平均得分略低,但“最佳4选1”结果更优,表明用户通过采样可以获得更优输出。(2)Seedream 4.0在简单和中等难度级别表现良好,展现出较强的生成响应能力;但在高难度级别,尤其是在单图编辑任务中性能下降明显。这凸显出在多模态理解与推理方面仍需改进,未来将通过引入相关数据对模型进行扩展以提升性能。

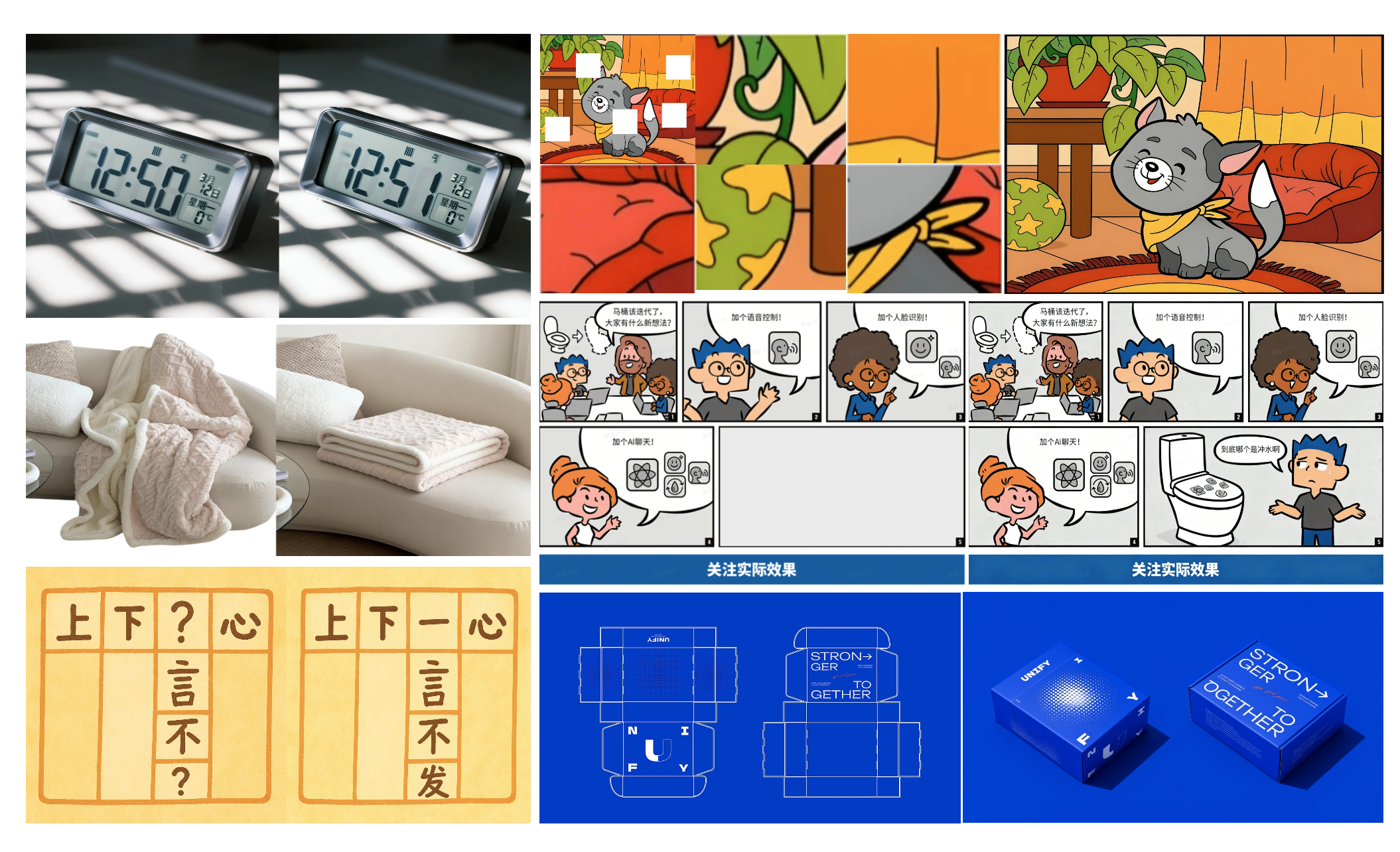

3.3 通过 Seedream 4.0 激发创意

本节展示了Seedream 4.0 的几个典型应用场景。这些示例仅凸显了其部分潜力,随着用户的进一步探索,将涌现出更多创造性应用。

3.3.1 精确编辑

图像编辑长期以来一直是生成模型面临的一个关键挑战,主要难点在于实现期望的修改,同时保留大部分原始视觉特征。Seedream 4.0 仅通过基于提示的输入即可实现高质量的图像编辑。它展现出强大的指令遵循能力,在很大程度上保持了周围区域的完整性的同时,实现了精确的修改。

图9 参考生成示例。

视觉内容。如图8所示,除了加法、删除、修改和替换等标准任务外,Seedream 4.0在多种实际编辑场景中表现出色。例如,在背景替换中,它能将前景与其他元素无缝融合;在人像精修中,其结果呈现出摄影级的真实感。

3.3.2 柔性参考

与图像编辑不同,基于参考的生成在保留与创造性之间面临更具挑战性的权衡。这种困难源于“应保留内容”的定义本身具有固有的模糊性。它可能是一个人的身份(ID)或知识产权(IP),一种特定的艺术风格,甚至是一个抽象概念。因此,其潜在应用场景更加广泛且多样化。如图9所示,Seedream 4.0支持在2D/3D领域之间实现无缝转换,并可适应不同视角。它能够仅通过一张参考图像生成衍生设计,例如玩偶、服装或表情包。此外,得益于Seedream 4.0的强大一致性,该技术可有效应用于身份敏感场景,包括生成不同风格的人物肖像照片,或为电影创作角色。

3.3.3 视觉信号可控生成

视觉信号,如Canny边缘、草图、修复掩码或深度图,长期以来一直是可控生成的关键组成部分。它们能够传递通常难以用语言描述的信息,例如人体姿态或精确的空间布局,从而实现更准确、更具针对性的生成。传统上,这一能力通过多个专用模型(如ControlNet [9, 26])实现。相比之下,Seedream 4.0 通过单一模型原生集成了这些功能。除了支持常见的视觉引导形式外,它还通过简单的笔触或草图支持创造性输入,并能够实现由视觉信号驱动的新式多图像组合。图10展示了若干示例。

图 10 视觉信号可控生成的示例。

3.3.4 上下文推理生成

随着多模态模型智能化程度的不断提高,一种新的上下文推理生成范式应运而生。传统的图像生成主要致力于生成严格遵循给定指令的输出。相比之下,基于推理的生成要求模型更进一步:在生成图像之前,必须提取隐含的上下文线索并推断出合理的结果。这一过程可能涉及扩展原始提示词以及解读参考图像。如图11所示,Seedream 4.0 在多种上下文理解任务中展现出推理能力,包括解释现实世界中的物理和时间约束,以及想象三维空间。此外,Seedream 4.0 还能够执行拼图解答、填字游戏和漫画续写等任务,同时忠实地保留输入图像的视觉风格和细粒度细节。

3.3.5 多图像参考生成

得益于多张图像提供的更丰富信息,多图像参考能够实现更具想象力和多样性的应用。除了传统的虚拟试穿或图像拼贴任务外,它还支持多个角色或物体的灵活组合,以及抽象风格迁移。与需要显式指定属性或风格的文本条件不同,多图像编辑迫使模型自主从参考图像中提取显著特征,并将其转移到目标图像中。如图12所示,Seedream 4.0能够处理包含超过十张输入图像的基于参考的编辑,同时在传递抽象风格(如折纸或巴洛克美学)方面保持高保真度。此外,它还能有效处理物体之间的相对尺度关系,生成具有意义的多物体组合,例如组装机械部件,展现出对物理世界结构的强健理解。

3.3.6 多图像输出

单图生成在许多需要连贯多图输出的创造性场景中是不足的。凭借在全局规划和上下文一致性方面的强大能力,Seedream 4.0 支持生成既保持角色一致又风格统一的图像序列。如图所示,

图11 推理生成示例。

图13,这使得基于给定字符的连续图像生成成为可能,尤其有利于分镜设计和漫画创作。Seedream 4.0 还能生成具有统一视觉形象的一组图像,这一特性对于基于IP的产品设计和表情符号创作具有极高价值。

3.3.7 高级文本渲染

Seedream 4.0 引入了增强的文本渲染能力,不仅限于简单展示,更可服务于实际应用。凭借智能理解与扩展能力,以及高精度的密集文本渲染能力,该模型支持各种复杂的文本与图形生成任务,包括用户界面、海报或示意图的布局设计,以及生成知识密集型可视化内容,如数学公式、化学方程式或统计图表,如图14所示。这些能力使得模型能够直接生成教育材料、技术手册或营销内容。此外,Seedream 4.0 还支持精确的文本感知编辑,包括内容替换、布局调整和字体修改,从而将其渲染能力拓展至实际工作流程,为各类工作场景提供支持。

3.3.8 自适应长宽比与4K生成

传统生成模型通常需要指定分辨率,而选择不合适的长宽比可能导致构图和布局欠佳。Seedream 4.0 引入了自适应长宽比机制(同时仍支持用户指定尺寸),使模型能够根据语义需求或参考物体的形状自动调整画布。如图15所示,这使得生成的图像具有更美观且符合语境的构图。此外,Seedream 4.0 进一步将支持的分辨率扩展至4K。这一进步已超越研究原型,达到适用于商业应用的图像质量。

图12 多图合成示例。

图13 多图像输出生成示例。

4结论

在本报告中,我们介绍了 Seedream 4.0,这是一个先进的多模态图像生成框架,它将一种高效且可扩展的扩散变压器与一种高压缩率 VAE 相结合,相比前代Seedream 3.0模型实现了超过十倍的加速,同时在各个方面均展现出卓越的性能。通过在文本到图像(T2I)和图像编辑任务上进行联合后训练,Seedream 4.0具备强大的多模态生成能力,支持多样化的输入与输出。其在创造性探索方面展现出广阔潜力,包括精确的图像编辑、基于参考的生成、多图像合成以及多图像输出。特别是,所设计的模型架构具有高度的效率与稳定性,使其能够被有效扩展,并在持续工作中实现了显著的性能提升。此外,借助先进的推理加速技术,Seedream 4.0能够在高分辨率下实现超快的图像生成与编辑。同时,它还具备强大的复杂内容生成能力,可支持专业场景中的高难度任务,例如以知识为中心的生成,这在以往模型中难以实现。随着其集成至Doubao、Jimeng/Dreamina [2]等平台,Seedream 4.0展现出巨大的潜力,有望成为内容创作领域中专业及日常应用的强大生产力工具。

图14高级文本渲染示例。

style="display: none !important;">