笔记:人工神经网络

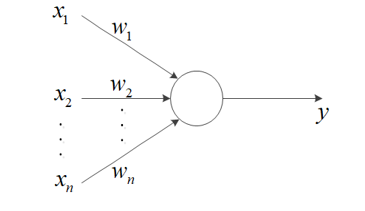

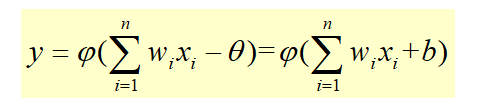

1.MP神经元

多输入单输出的结构,其中x代表输入内容,w为权重,θ为阈值,b=-θ,激活函数(·)为阶跃函数。

简而言之:当输入之和大于阈值时,输出1,否则为0

2.感知机

输入特征向量,输出实例的类别(+1,-1)

单层感知机可以构造出简单逻辑门(与,或,与非),或非门需要两层。

理论上,多层感知机可以表示计算机内部的复杂计算,但缺少有效的训练算法。

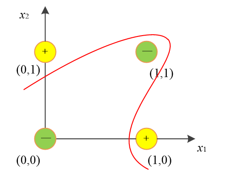

3.线性可分

在分布上两类实例若能通过一条直线完整分割则为线性可分。

4.人工神经网络(Artificial Neural Network)

类似感知机,包括输入层(Input Layer)、一个或者多个中间层(隐层,Hidden Layer)和输出层(Output Layer)。

注:输入输出都可以是多个。

中间层可由多个现代人工神经元(工作原理类似MP神经元)构成。由于MP神经元激活函数过于简单,非0即1,现代人工神经元采用了更有效的激活函数。

5.常见激活函数

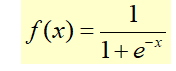

1.Sigmoid函数

相比于阶跃函数更连贯,数学性质更好。

优点:导数可直接用函数值计算,简单高效。常用于解决二分类问题,

缺点:边缘斜率趋近于0,难以更新。

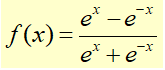

2.Tanh(双曲正切)函数

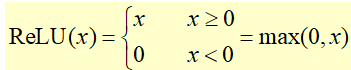

3.ReLU函数

Rectified Linear Unit(修正线性单元),深层神经网络中经常使用。

左侧存在神经元死亡问题,某些神经元会永远不启动

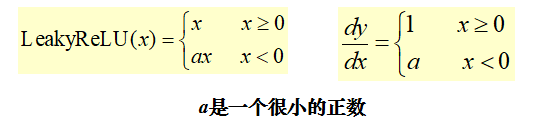

4.Leaky ReLU函数

改进RELU函数,输入小于零时返回一个较小的负斜率值。

缓解了神经元死亡问题。