【图像算法 - 17】慧眼识“果”:基于深度学习与OpenCV的苹果智能检测系统(附完整代码)

摘要: 告别传统人工分拣的低效与主观!本文将带您构建一套基于目标检测模型与OpenCV图像处理技术的苹果坏果智能识别系统。我们将从零开始,涵盖数据准备、模型训练到推理部署的完整流程,实现对苹果表面霉变、腐烂、磕碰、虫蛀等缺陷的精准定位与分类,显著提升分拣效率与准确性,为智慧农业与食品质检注入AI动力!

关键词: YOLO, 苹果检测, 坏果识别, 缺陷检测, OpenCV, 计算机视觉, 水果分拣, 智慧农业, Python, 目标检测

【图像算法 - 17】慧眼识“果”:基于深度学习与OpenCV的苹果智能检测系统

1. 引言:AI赋能智慧农业,让坏果无处遁形

在水果种植、采摘、仓储和销售的产业链中,品质分拣是至关重要的一环。传统的人工分拣方式不仅效率低下、成本高昂,而且容易受到工人主观判断和疲劳程度的影响,导致分拣标准不一,优质果品可能被误判,而坏果也可能混入市场,影响品牌形象和消费者体验。

随着计算机视觉与深度学习技术的飞速发展,AI智能分拣已成为解决这一痛点的革命性方案。通过训练AI模型自动识别水果的外观缺陷,可以实现高速、客观、标准化的自动化分拣。

本文将聚焦于苹果这一常见水果,利用先进的目标检测模型,结合OpenCV的强大功能,构建一个高效、准确的苹果坏果识别检测系统。我们的目标是让机器“看”懂苹果,精准定位并分类其表面的各种缺陷。

2. 技术选型:深度学习 + OpenCV 的黄金组合

- YOLO12 (You Only Look Once v12):

- 实时性王者: YOLO系列以其卓越的实时检测性能著称。YOLO12作为其最新迭代版本,在保持高速推理的同时,进一步提升了检测精度和小目标识别能力,非常适合流水线上的高速分拣场景。

- 高精度检测: 采用更先进的网络架构和训练策略,能够精准定位苹果及其缺陷区域,即使在复杂背景或轻微遮挡下也能保持稳定表现。

- 端到端训练: 简化了模型开发流程,从原始图像直接输出检测框和类别,易于集成与部署。

- OpenCV (Open Source Computer Vision Library):

- 图像预处理专家: 负责图像的读取、缩放、色彩空间转换(如BGR转RGB)、去噪、增强等,为YOLO12提供高质量的输入。

- 结果可视化大师: 将YOLO12输出的检测框、类别标签和置信度,以直观的彩色矩形框和文字形式叠加回原图,便于结果展示与分析。

- 后处理引擎: 可用于实现更复杂的逻辑,如计算缺陷面积、判断缺陷严重程度、控制机械臂分拣等。

- 跨平台集成枢纽: 作为连接AI模型与工业相机、PLC控制系统或用户界面的桥梁。

3. 数据准备:构建高质量的苹果缺陷数据集

“Garbage in, garbage out.” 模型的性能很大程度上取决于训练数据的质量。我们构建了一个专门用于苹果坏果识别的数据集。

3.1 数据采集

-

来源: 从果园、水果市场、超市等多场景采集真实苹果图像。

-

多样性: 包含不同品种(如红富士、嘎啦、蛇果)、不同成熟度、不同光照条件(自然光、室内灯光)、不同背景(单色背景布、枝叶、包装箱)下的苹果。

-

缺陷类型:

当前数据集只将坏果统归为一类;(抛砖引玉)

后续可细分以下几类常见缺陷:

-

霉变 (Mold): 表面出现白色、绿色或黑色的霉斑。

-

腐烂 (Rot): 果肉软化、变色、有液体渗出。

-

磕碰 (Bruise): 因碰撞导致的局部凹陷、变色(青紫色)。

-

虫蛀 (Insect_Bite): 被虫子啃食留下的孔洞或疤痕。

-

(可选) 正常 (Normal): 用于训练模型区分好果与坏果。

-

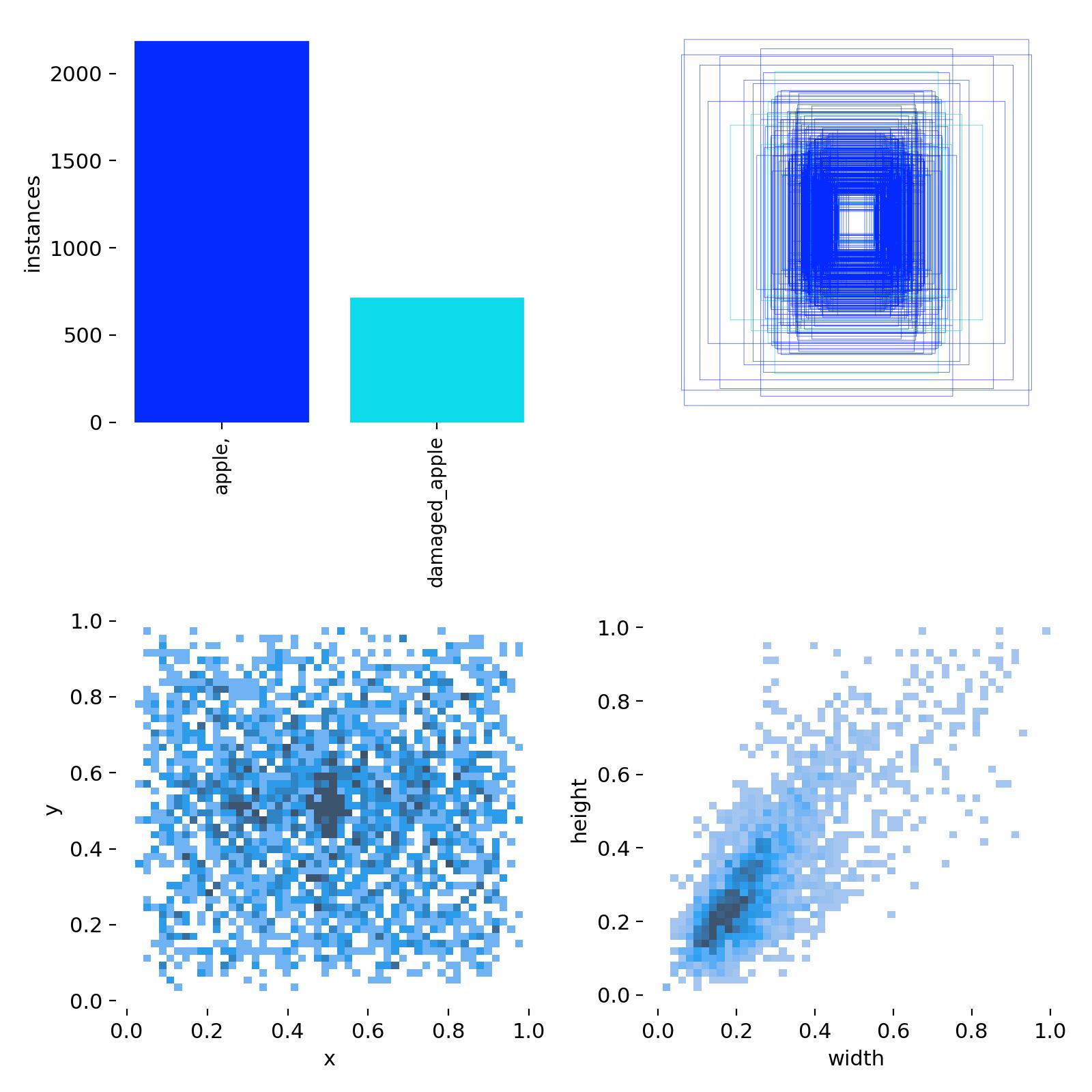

数量: 收集了超过2000张高质量图像,确保各类缺陷样本充足且分布均衡。

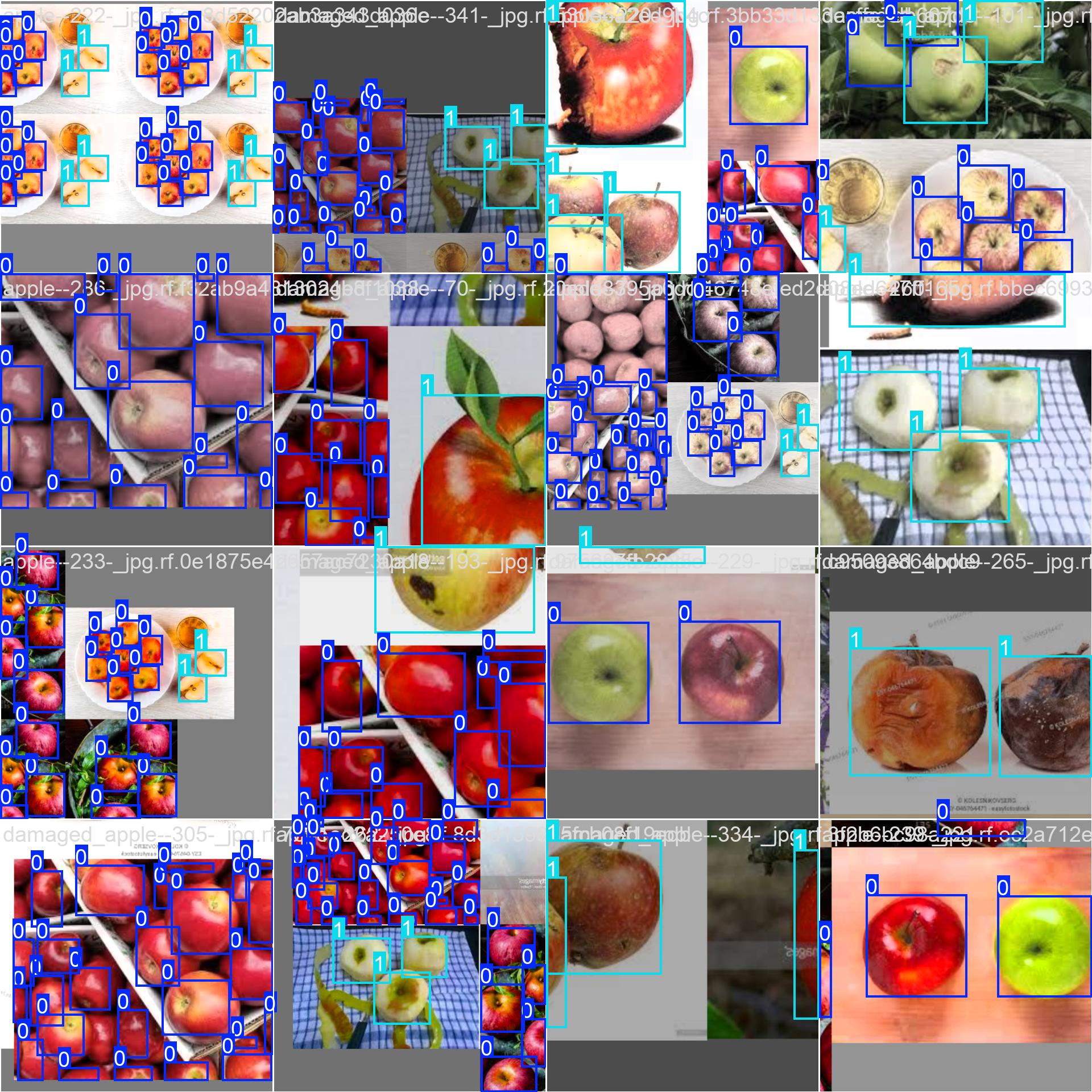

3.2 数据标注

-

工具: 使用 Labelme、CVAT 或 Roboflow 等开源标注工具。

labelme数据标注保姆级教程:从安装到格式转换全流程,附常见问题避坑指南(含视频讲解) -

方法: 采用 矩形框 (Bounding Box) 标注。为图像中的每个苹果(无论好坏)以及其上的每个独立缺陷区域绘制边界框。

-

类别定义 (示例):

names:0: Apple # 正常苹果1: Damaged_apple # 霉变- 注:也可选择只标注缺陷,不标注“Normal”类别,模型只负责找出所有缺陷区域。

-

格式: 保存为 YOLO 格式的

.txt文件(每行:class_id center_x center_y width height,坐标已归一化)。

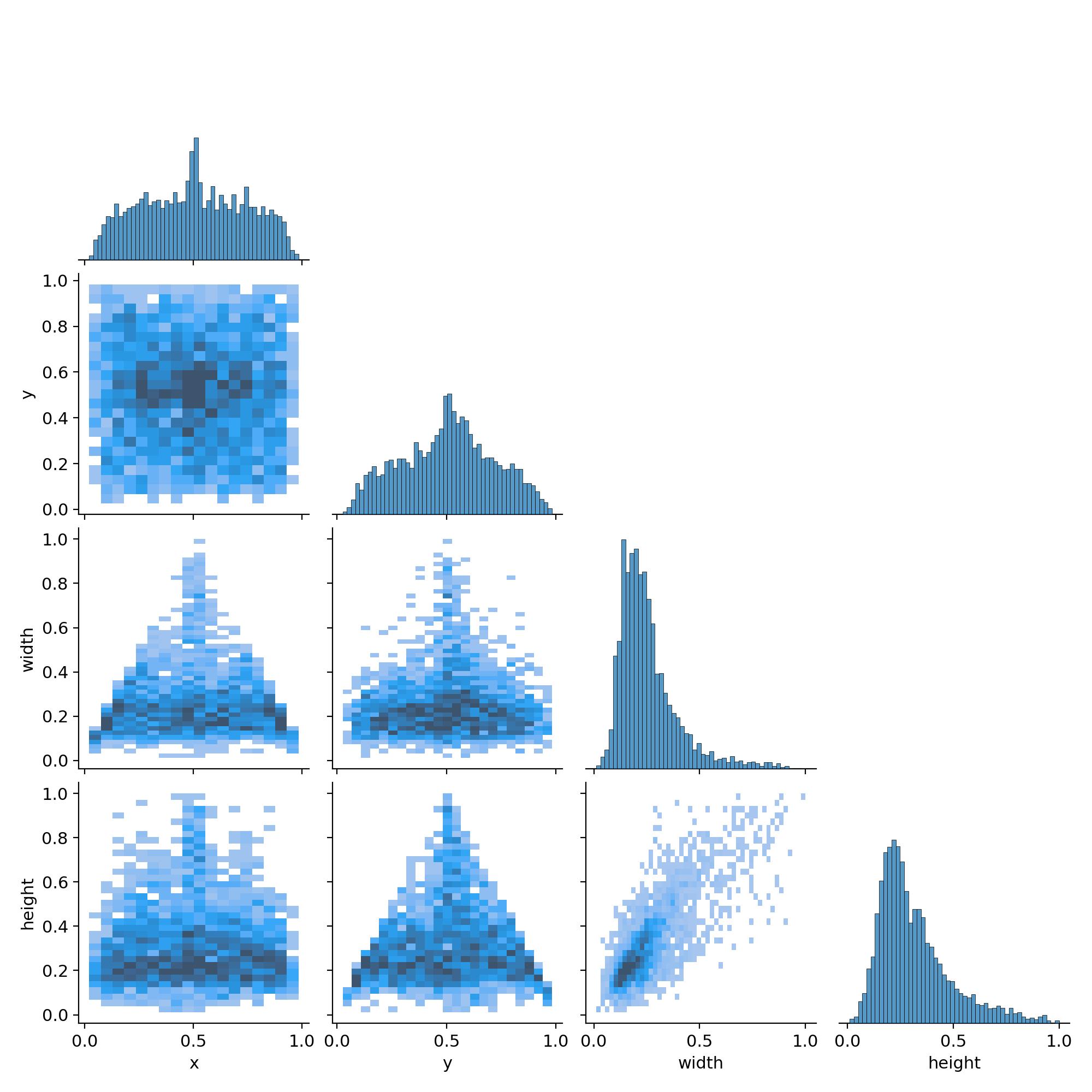

3.3 数据集划分

-

按 7:2:1 的比例划分为 训练集 (train)、验证集 (val) 和 测试集 (test)。

-

创建数据配置文件

# apple_defects.yaml path: /path/to/apple/dataset train: images/train val: images/val test: images/testnames:0: apple1: damaged_apple

4. 模型训练:用YOLO12“学习”识别坏果

利用Ultralytics YOLO的API,训练过程变得异常简单。

4.1 环境准备

【图像算法 - 01】保姆级深度学习环境搭建入门指南:硬件选型 + CUDA/cuDNN/Miniconda/PyTorch/Pycharm 安装全流程(附版本匹配秘籍+文末有视频讲解)

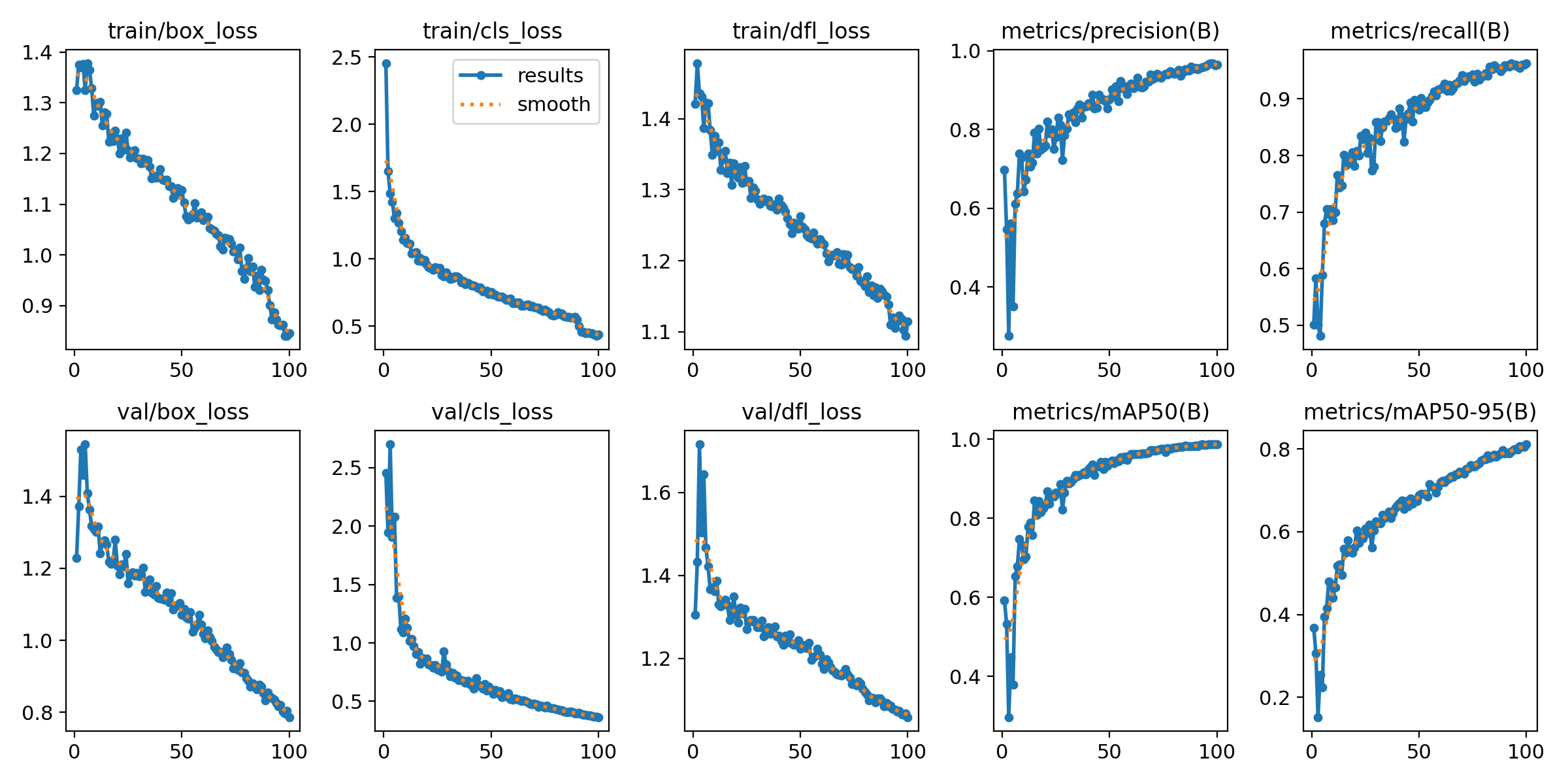

4.2 开始训练

使用命令行启动训练:

yolo train \model=yolo12n.pt \ # 选择YOLO12n模型 (平衡精度与速度)data=apple_defects.yaml \ # 指向数据配置文件epochs=100 \ # 训练轮数imgsz=640 \ # 输入图像尺寸batch=16 \ # 批次大小 (根据GPU显存调整)device=0 \ # 使用GPU 0 (若有多卡可设为 0,1,2,3)name=apple_defect_yolo12m_v1 \ # 训练任务名称patience=15 \ # 早停轮数lr0=0.01 \ # 初始学习率optimizer=AdamW \ # 优化器cos_lr=True # 使用余弦退火学习率

- 关键参数:

model: 可选择yolo12n(nano, 超快),yolo12s(small),yolo12m(medium),yolo12l(large),yolo12x(extra large)。根据您的硬件和精度需求选择。data: 必须正确指向您的apple_defects.yaml。epochs,imgsz,batch: 核心训练参数。name: 训练结果将保存在runs/detect/name/目录下。

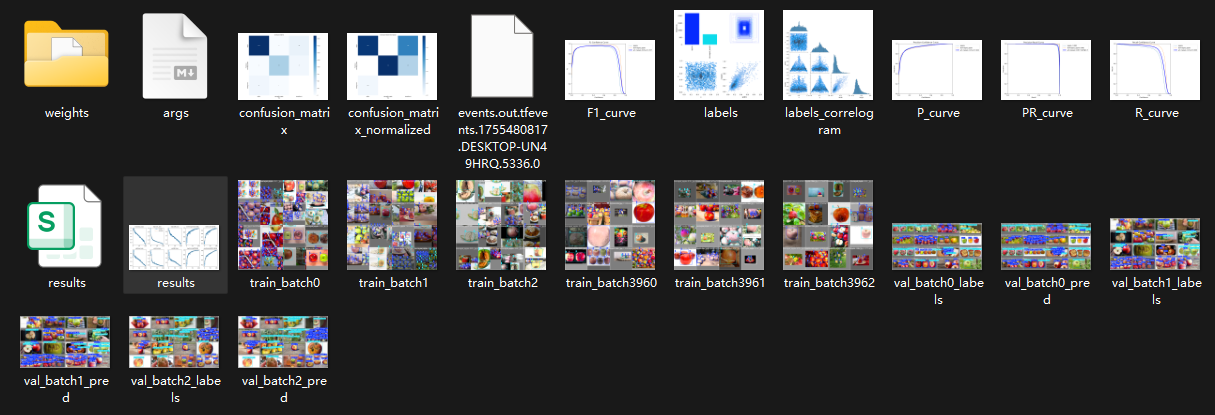

4.3 监控与评估

-

训练过程中,Ultralytics会自动在

runs/detect/apple_defect_yolo12m_v1/目录生成:

results.png: 展示训练/验证损失、mAP@0.5、mAP@0.5:0.95等指标曲线。confusion_matrix.png: 分析各类别间的混淆情况。val_batch*.jpg: 验证集上的预测效果图。

-

训练结束后,使用测试集评估最终性能:

yolo val model=runs/detect/apple_defect_yolo12m_v1/weights/best.pt data=apple_defects.yaml -

评估结果将给出在测试集上的 mAP@0.5 和 mAP@0.5:0.95 等关键指标,反映模型的综合性能。

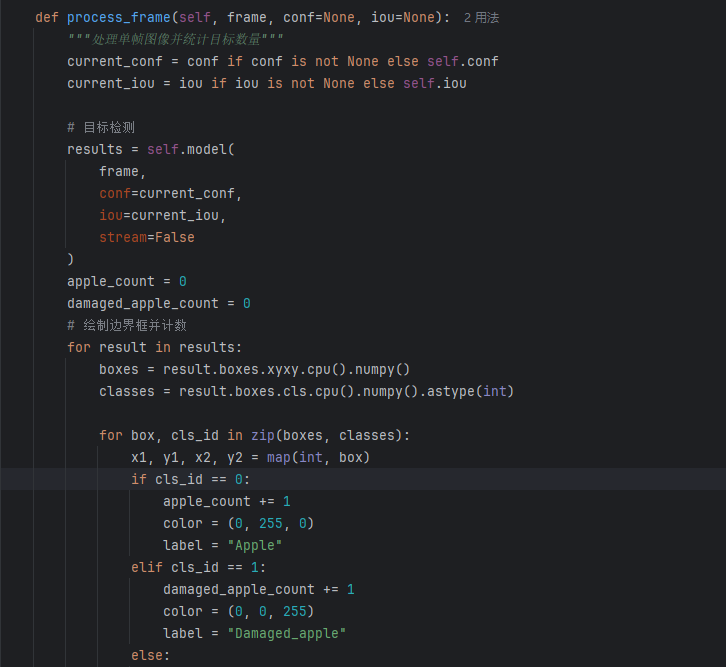

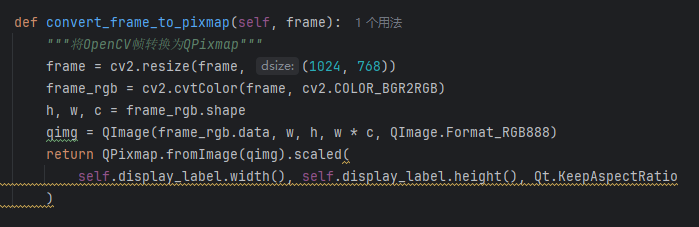

5. 推理与可视化:OpenCV展现AI慧眼

训练好的模型 (best.pt) 可用于实际检测。以下是核心代码:

6. 代码详解

- 模型加载:

YOLO(MODEL_PATH)加载训练好的权重。 - 预测:

model.predict()执行推理,返回包含边界框、类别、置信度等信息的结果。 - 结果解析: 遍历

boxes,提取xyxy(左上、右下坐标)、cls(类别ID)、conf(置信度)。 - 可视化: 使用

cv2.rectangle绘制不同颜色的框,cv2.putText添加标签。 - 逻辑判断: 可根据检测到的缺陷类别和数量,自动判断苹果的整体品质(如:只要检测到一个

Mold或Rot,即可判定为坏果)。

7. 应用场景与展望

- 自动化分拣线: 集成到传送带系统,配合机械臂,实现坏果的自动剔除。

- 在线质检: 在包装或销售环节,对苹果进行快速质量抽检。

- 果园管理: 分析采摘后的果实损伤情况,追溯损伤原因,优化采摘和运输流程。

- 智慧零售: 在无人超市或智能货架中,自动识别并定价不同品质的水果。

- 未来方向: 结合实例分割(YOLO12-seg)更精确地描绘缺陷轮廓;利用深度相机进行3D缺陷分析;部署到边缘设备(如Jetson)实现端侧实时检测。

8. 总结

本文详细阐述了如何利用YOLO12和OpenCV构建一个高效的苹果坏果识别检测系统。从数据准备、模型训练到推理部署,我们提供了一套完整的解决方案。这套系统能够显著提升水果分拣的自动化水平和准确性,降低人力成本,保障果品质量,是智慧农业落地的典型应用。

核心价值:

- 高效精准: AI模型远超人眼的识别速度和一致性。

- 流程清晰: 技术栈成熟,易于复现和部署。

- 扩展性强: 方法可迁移至其他水果(如梨、桃、柑橘)或工业品缺陷检测。