R语言机器学习算法实战系列(二十七)LASSO 与 Adaptive LASSO 在特征选择中的比较与应用

禁止商业或二改转载,仅供自学使用,侵权必究,如需截取部分内容请后台联系作者!

文章目录

-

- 介绍

-

- 方法原理

-

- LASSO 原理

- Adaptive LASSO 原理

- 模拟实验设计

- 结果与可视化分析

-

- RMSE Boxplot

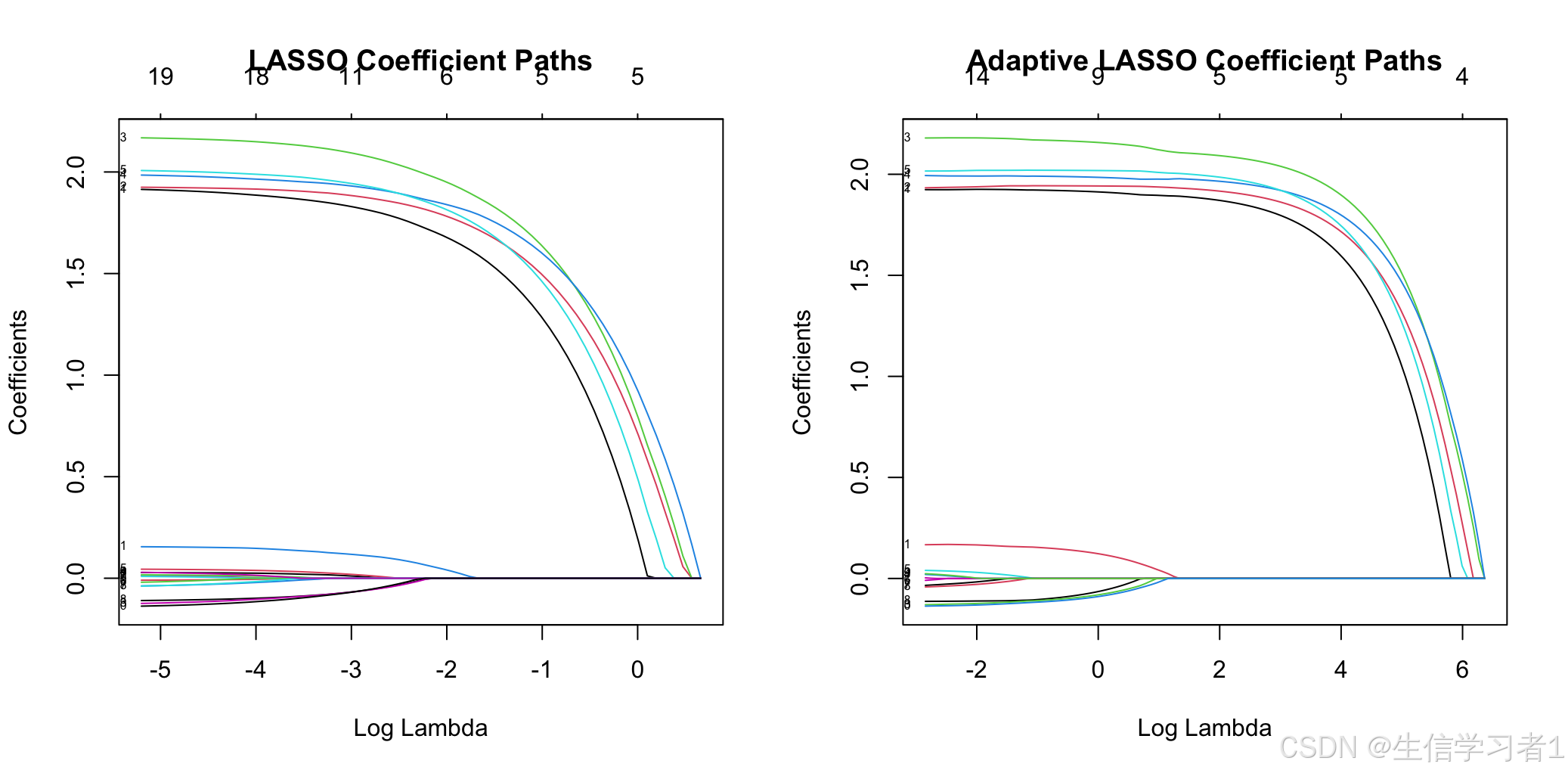

- 系数收缩路径图

- 加载R包

- 模拟数据

- 运行

- Boxplot 结果可视化

- 正则路径图

- 总结

- 系统信息

- 参考

介绍

在高维数据分析中,特征选择(Feature Selection)是提高模型泛化能力、减少计算成本并提升可解释性的关键步骤。LASSO(Least Absolute Shrinkage and Selection Operator)是一种广泛应用的线性模型正则化方法,能够通过对系数的 L1 范数惩罚实现变量选择。而 Adaptive LASSO(自适应 LASSO)则是在 LASSO 基础上的改进方法,引入了对各个变量的权重惩罚,实现更加灵活和精确的变量筛选。

本节内容通过模拟实验,系统地比较了这两种方法在特征选择中的表现,包括它们的系数收缩路径、预测误差(RMSE)分布以及整体稳健性,帮助学习者理解两种方法的理论基础和实际应用差异。

方法原理

LASSO 原理

LASSO 通过在最小化残差平方和的基础上引入 L1 正则项:

β ^ lasso = arg min β { 1