AI Agent 入门指南:从 LLM 到智能体

AI. AI. AI. 最近耳朵里是不是总是被这些词轰炸?特别是“Agent”、“AI Agent”、“智能体”、“Agentic”…… 感觉一夜之间,AI 就从我们熟悉的聊天框里蹦出来,要拥有“独立思考”和“自主行动”的能力了?

说实话,一开始我也被这些词搞得有点晕。很多解释要么太技术化,各种框架、算法扑面而来;要么又太基础,讲了半天还是感觉没抓住重点。

如果你跟我一样,不是程序员,没有深厚的技术背景,但平时一直在用 ChatGPT、文心一言、通义千问这些 AI 工具,也想搞明白 AI Agent 到底是什么,以及它将来可能会如何影响我们的生活和工作,那恭喜你,这篇文章就是为你写的!

今天,我就用最简单、最贴近生活的例子,带你一起走完一个“1-2-3”的学习路径:从你熟悉的 LLM(大型语言模型),到 AI 工作流(AI Workflow),再到最终的 AI Agent(AI 智能体)。相信我,那些听起来吓人的“RAG”、“ReAct”,拆开了看一点都不复杂!

咱们,这就开始!

第一层:你熟悉的“超级大脑”——大型语言模型(LLM)

咱们先从最熟悉的第一层说起。你平时用的那些强大的 AI 聊天机器人,比如 ChatGPT、Google Gemini、Claude、国内的文心一言、通义千问等等,它们的核心其实都是构建在大型语言模型(LLM)这个基础上的应用。

你可以想象一下,LLM 就像一个拥有海量知识的“超级大脑”。我们人类(你)给它一个输入(也就是 Prompt,你的问题或指令),它就根据它在训练中学到的海量数据,给出一个输出(它的回答或生成的内容)。

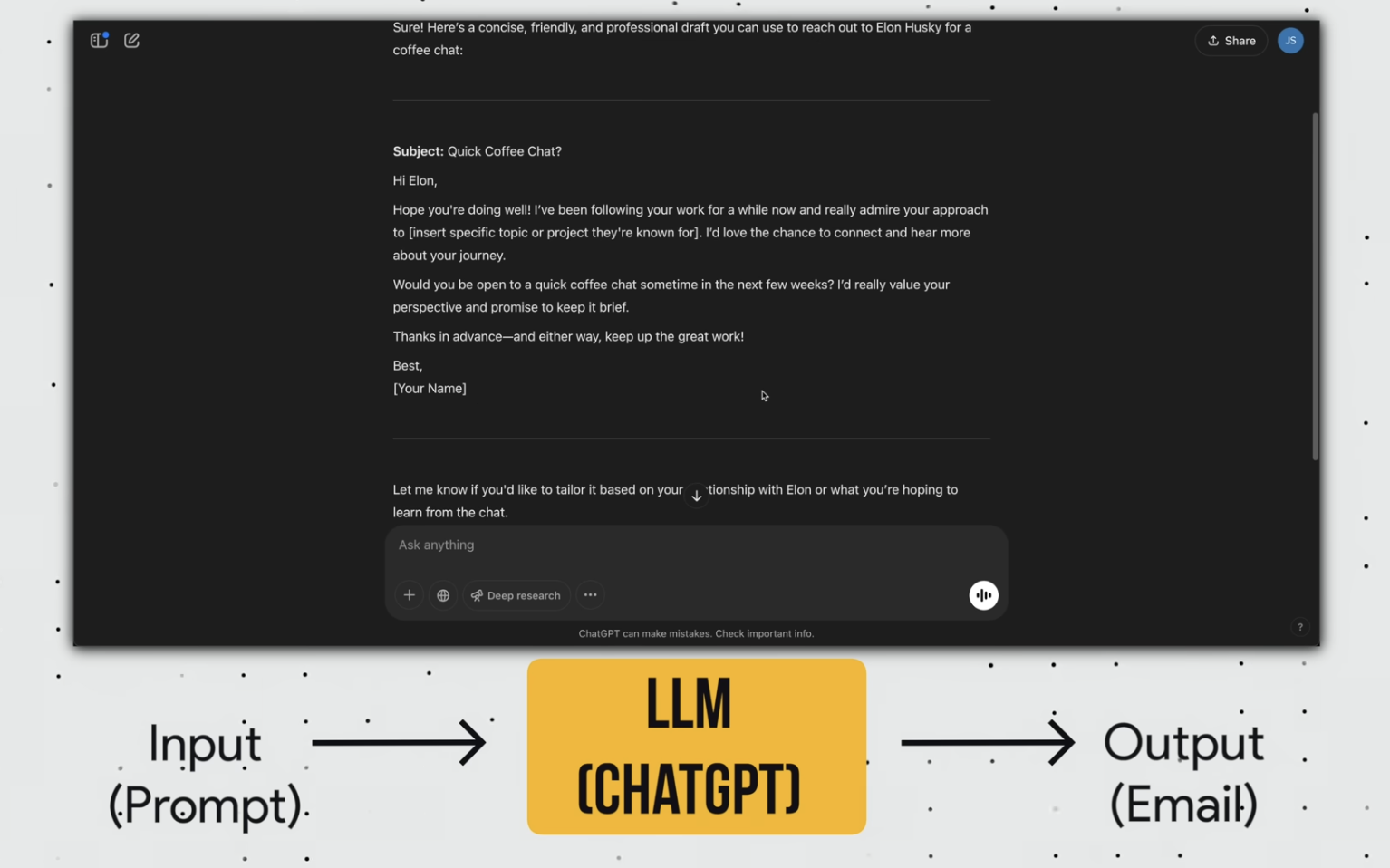

举个最简单的例子:我让 ChatGPT 帮我写一封约咖啡的邮件。我的 Prompt 就是输入,它瞬间生成的那封比我本人写得流畅、客气一百倍的邮件,就是输出。到这里是不是感觉很简单?没啥难的!

但是,问题来了。如果我问 ChatGPT:“我下周三跟 Elon Husky 约咖啡是几点?”

你懂的,就算你没试过,你也知道它肯定会懵圈,然后回复你一句“我不知道你的个人日程信息”。为什么?因为它没法访问我的个人日历!

这就暴露了大型语言模型的两个关键“软肋”:

-

知识不全: 它们虽然学了很多互联网上的公共数据,但对我们个人的私密信息、公司内部的数据,或者某些实时变化的信息(比如我的最新日历、最新的天气),是一无所知的。

-

太“被动”: 它们就像一个被动等指令的机器人。你问一句,它答一句。你给它个 Prompt,它给个 Output。它不会主动去外部世界获取信息,也不会自己决定去做点什么。

记住 LLM 的这两个特点,我们继续往下走,看看怎么解决这些问题。

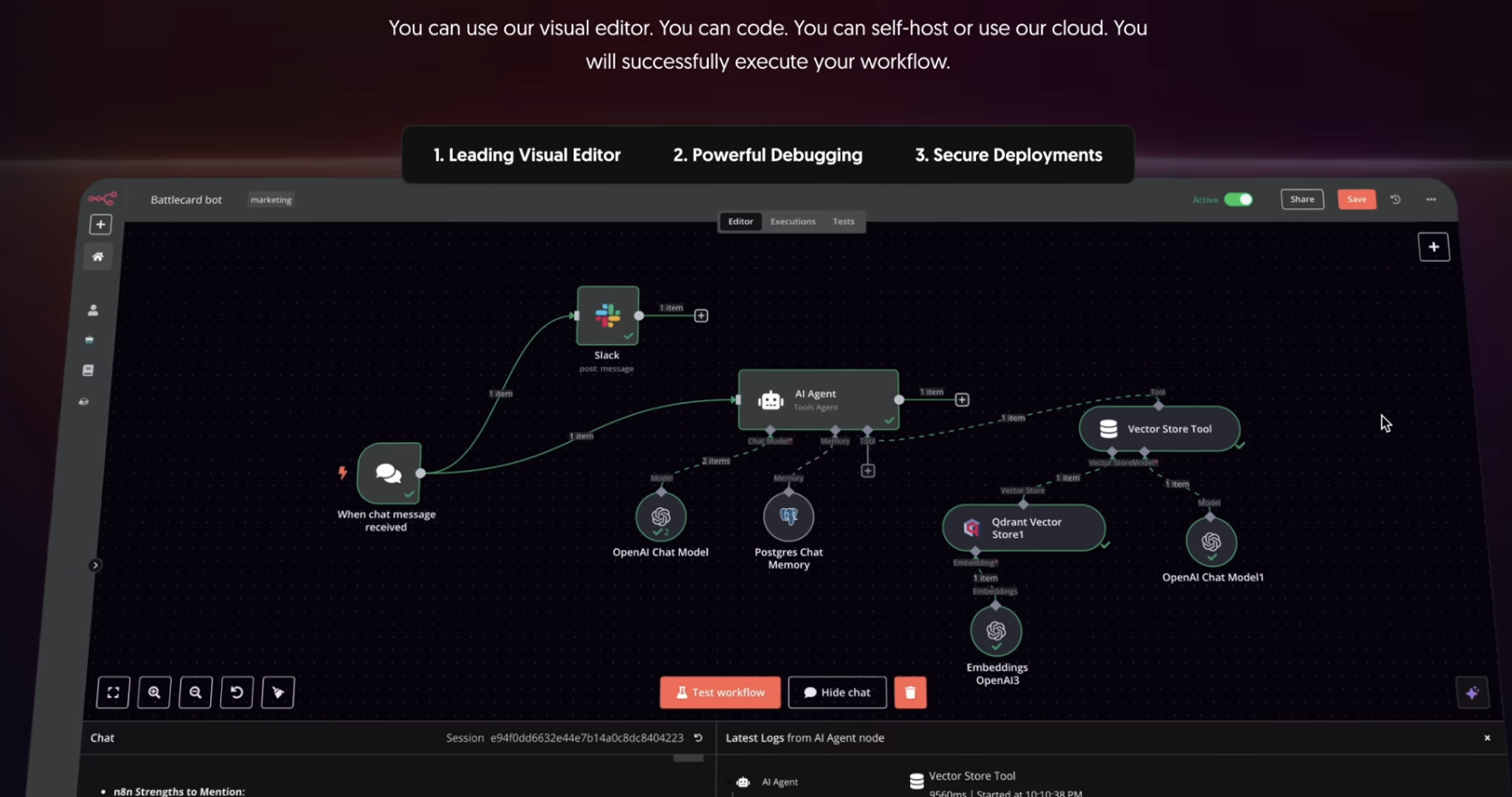

第二层:听话的“流水线工人”——AI 工作流(AI Workflow)

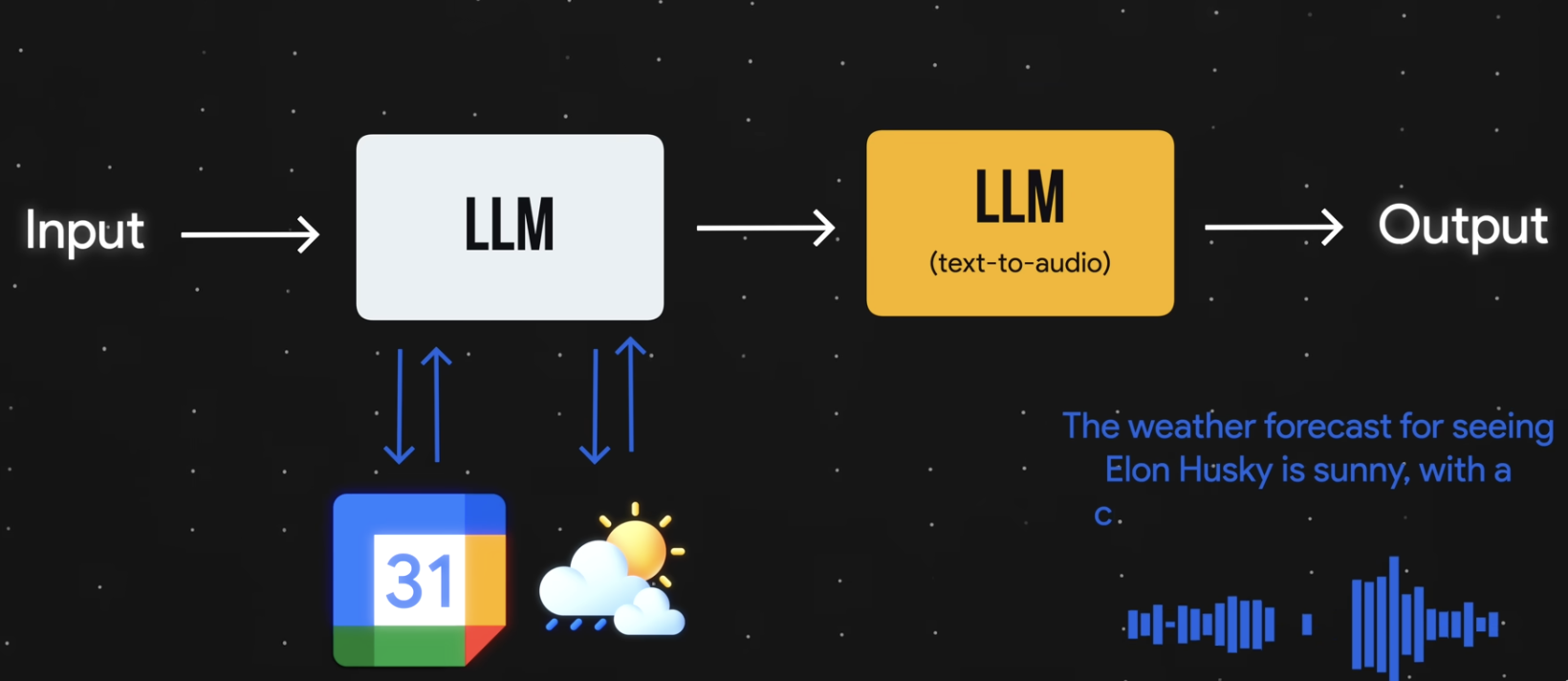

既然 LLM 自己不知道我的日历,那我们能不能给它“赋能”呢?这就是 AI 工作流要做的事情。

我们可以在 LLM 的外面,搭建一个“工作流程”。比如,我这个人类,可以预设一个逻辑:“以后只要我问关于个人日程的问题,我的指令先不要直接给 LLM,而是先触发一个‘查日历’的动作。查到日历数据后,把数据连同我的问题一起,打包喂给 LLM,让它根据这些信息回答。”

如果按照这个逻辑实现了,下次我再问“我下周三跟 Elon Husky 的咖啡约会是几点?”,我的这个问题就会先触发“查日历”这个步骤。系统查到日历信息(比如是下午 3 点),然后把“我下周三跟 Elon Husky 约会是下午 3 点”这个信息,连同我的问题,一起发给 LLM。LLM 收到信息后,就能准确地回答我了!

看起来很智能对不对?但新问题又来了。如果我紧接着问:“那天下雨吗?”

这时候,我的这个“查日历”工作流就又会“卡壳”了。为什么?因为它只能严格遵循我预设好的那个“路径”:永远是“查日历”。我的日历里可没有天气信息!

这就是 AI 工作流的一个根本特点:它只能严格、机械地遵循人类预设好的、固定不变的“路径”或“步骤”去执行任务。 它就像一条“流水线”,每一步做什么都是我们人类提前设计好的。用技术话说,这个固定的路径,就是它的“控制逻辑”,是人来编写和控制的。

就算我把这个流程搞得更复杂:比如先查日历,再通过天气 API 查天气,甚至再加一个文语转换模型把最终答案读出来。听起来功能很强大了,对不对?但本质上,它依然只是一个 AI 工作流。 为什么?因为它每一步做什么,调用哪个工具,都是我这个人类提前设定好的。只要是由人类在做决策,决定一步一步怎么走,它就还不是 AI Agent。

顺便提一个你可能听过的高级词:“RAG”(Retrieval Augmented Generation,检索增强生成)。这个词在 AI 圈子里被说得很多,听起来很高大上。其实你简单理解,它就是一种特殊的 AI 工作流!它的核心功能就是:在 AI 模型生成回答之前,先去外部世界(比如你的文档库、数据库、互联网)“检索”相关的“增强”信息,然后把信息喂给模型,让它基于这些信息生成更准确、更及时的回答。 所以,“检索”+“生成”,就是 RAG 的本质,它是一种让 LLM 突破自身知识限制的有效工作流。你看,是不是没那么复杂了?

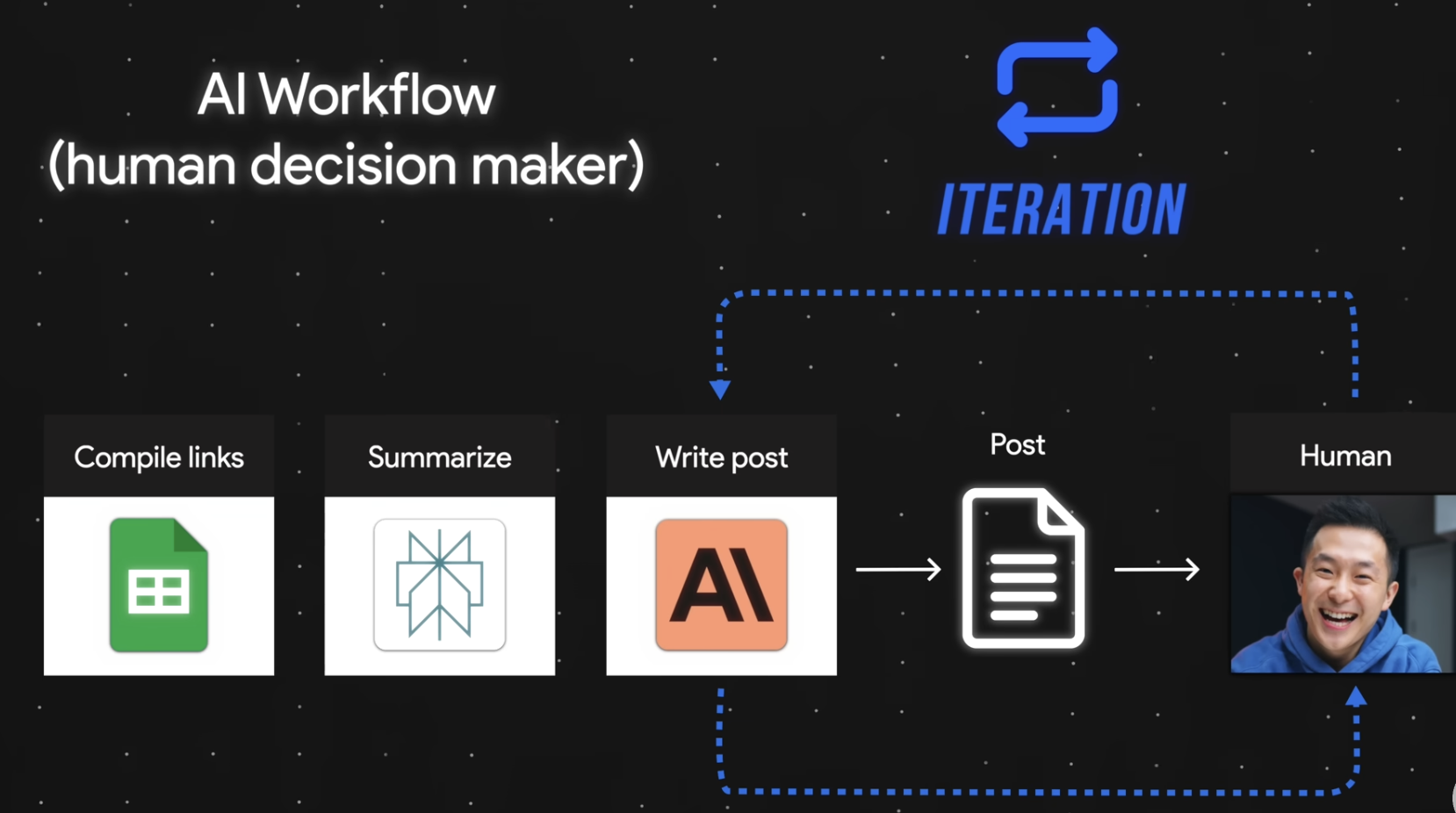

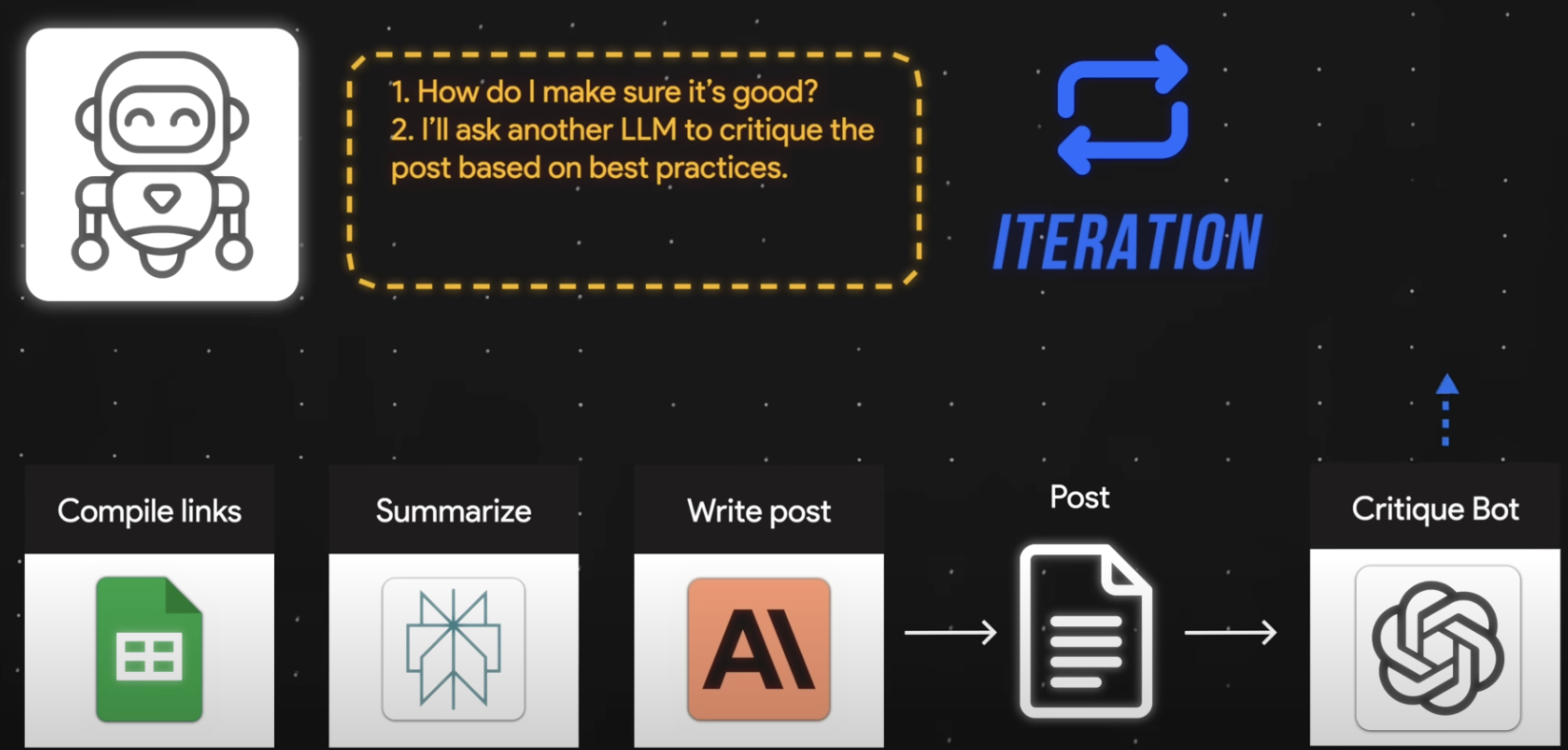

我之前用 Make.com 搭建过一个很典型的 AI 工作流,你听听是不是这个逻辑:

-

我把收集到的新闻文章链接放到一个 Google Sheets 表格里。

-

我的这个自动化工作流启动后,先去读取 Google Sheets 里的链接。

-

然后把链接发给 Perplexity,让 Perplexity 帮我总结文章内容。

-

接着把 Perplexity 总结好的内容,发给 Claude(一个 LLM),并配合我预设好的一个 Prompt,让 Claude 帮我写成适合发 LinkedIn 和 Instagram 的社交媒体推文。

-

最后设置成每天早上 8 点自动运行一次。

你看,这就是一个标准的工作流:每一步都由我这个人类事先设定好了——先表格、再 Perplexity、然后 Claude、最后定时。人是这个流程的决策者和设计者,它只是按部就班地执行。

再加一个点:如果我对 Claude 生成的 LinkedIn 推文不满意(比如我觉得它写得不够吸引人),我得手动去修改那个给 Claude 的 Prompt,然后重新运行一下这个工作流。这个“试错-调整-再运行”的过程,现在还是由我这个人类在完成。记住这一点,因为待会儿讲 Agent 的时候,它就不同了!

第三层:能“思考”和“行动”的自主个体——AI Agent

好,终于来到第三层,也是最近最让人兴奋的概念:AI Agent(AI 智能体)!

核心区别是什么?还记得刚才的 AI 工作流吗?是人类决定每一步怎么走。而 AI Agent 最关键的变化在于:把那个做决策的人类,换成了一个 LLM!

简单来说,一个真正的 AI Agent,不再是一个只等你下指令、按固定流程跑的机器人。它更像是一个拥有某个“目标”后,能够自己去思考、自己去行动,想方设法达成目标的“智能体”。

它的核心能力体现在两个方面(这也是为什么很多 Agent 框架被称为 ReAct 的原因,ReAct = Reason + Act):

-

它必须能“思考”(Reason): 当你给 Agent 一个目标(比如“帮我写一篇基于最新新闻的社交媒体推文”)时,它不会傻等指示。它会自己动脑子,像人一样“思考”:怎么做最有效率? 我需要新闻内容,是自己去网上找然后复制粘贴吗?好像太慢了。哦,我可以只收集新闻链接,然后调用一个工具自动抓取内容并总结!这个方案听起来不错!它会自己选择最佳的路径和方法。

-

它必须能“行动”(Act): 光想没用,Agent 必须能把想法付诸实践。它会自己去调用各种外部工具来完成任务。比如,它决定要收集链接并抓取内容,它会自己选择并调用合适的工具(比如一个搜索引擎 API、一个网页抓取工具、或者像 Make.com 那样能连接各种服务的平台)来执行这些操作。再比如,要写推文,它会自己决定调用哪个 LLM,使用什么样的 Prompt,并把之前获取到的新闻总结作为输入。

所以,当一个 AI 接收到一个任务/目标后,如果它能够:

-

自己“思考” 达成目标的步骤和方法(Reason)

-

自己“行动” 去调用工具执行这些步骤(Act)

-

自己“观察” 行动的结果是否符合预期

-

自己“决定” 是否需要调整计划或重复步骤(Iterate)

-

直到最终达成目标

那它就是一个 AI Agent!关键是:决策者从人类变成了 LLM 自己。

还记得刚才我在 AI 工作流里手动修改 Prompt 吗?在 Agent 的世界里,它还能做得更多:

一个高级的 AI Agent,甚至拥有自主迭代(Iterate)和优化的能力。比如,它写完第一版的 LinkedIn 推文后,可能会自己调用另一个 LLM 来“评价”这篇推文质量如何,是否符合要求。如果评价反馈说“不行,不够吸引人”,Agent 会根据这个反馈,自己调整推文的内容或写作策略,然后再让评价 LLM 检查,直到写出它认为最佳的版本。整个“生成-评价-修改”的循环,Agent 自己就能完成,不需要我这个人类一直盯着、手动修改。

再举个更具象的例子。AI 领域的牛人吴恩达(Andrew Ng)之前演示过一个 AI 视觉 Agent。你给它一个目标:“在视频素材里找到所有出现‘滑雪的人’的片段”。

这个 Agent 在后台做了什么呢?它首先会“思考”:一个“滑雪的人”大概长什么样?(嗯,应该是一个人在雪地里,穿着滑雪板,可能速度很快?)然后它开始“行动”:它会自己去浏览视频里的每一帧画面,调用图像识别或动作捕捉等工具,尝试识别出符合它“思考”出来的特征的画面。一旦找到了它认为是“滑雪的人”的画面,它就会给对应的视频片段打上标签,并把这些片段提取出来呈现给你。

这个过程最厉害的地方在于:识别“滑雪的人”、判断画面、打标签、提取片段,整个复杂的任务,是这个 Agent 自己根据目标,自主地进行“思考”和“行动”来完成的,而不是预先由人类把视频都看一遍,手动给每一段打好各种标签(比如‘滑雪者’、‘雪山’、‘雪地’等等),Agent 只是按照人类打好的标签去检索。 这种根据目标自主规划和执行的能力,就是 Agent 和传统工作流的根本区别。

总结一下:从 LLM 到 Agent 的进阶之路

好了,咱们一起回顾一下今天走过的“1-2-3”路径:

-

第一层 LLM: 你给输入,它给输出,很被动,知识有限。

-

第二层 AI 工作流: 你给输入,并给它设定好固定的步骤(人类是决策者),它按照你的步骤去调用外部工具(比如查日历、查天气、查数据库)获取信息,再给 LLM 处理,最终给输出。流程固定,需要人类来调整和优化。

-

第三层 AI Agent: 你给一个目标,LLM 自己会“思考”(Reason),决定要采取哪些“行动”(Act),自己去调用工具,自己观察结果,甚至能自主“迭代”优化,最终达成目标(LLM 是决策者)。 它是一个更智能、更自主的“个体”。

AI Agent 正在让 AI 从一个被动的工具,变成一个能理解你的意图、自主规划并执行任务的“智能助理”。虽然目前可能很多 Agent 还不完美,但毫无疑问,它们代表着 AI 应用的一个重要发展方向,也预示着未来我们的工作和生活方式可能会因此发生改变。

希望这篇文章能帮你揭开 AI Agent 的神秘面纱,让你不再觉得这些词高不可攀。理解了这些基础概念,你就能更好地把握 AI 发展的脉搏啦!