小米MiMo:7B模型逆袭AI大模型战场的技术密码

小米MiMo:7B模型逆袭AI大模型战场的技术密码

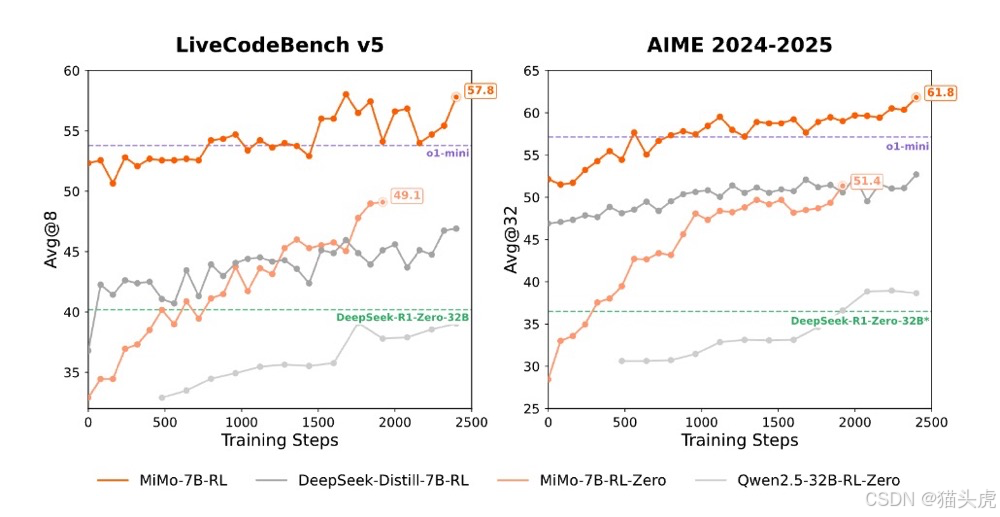

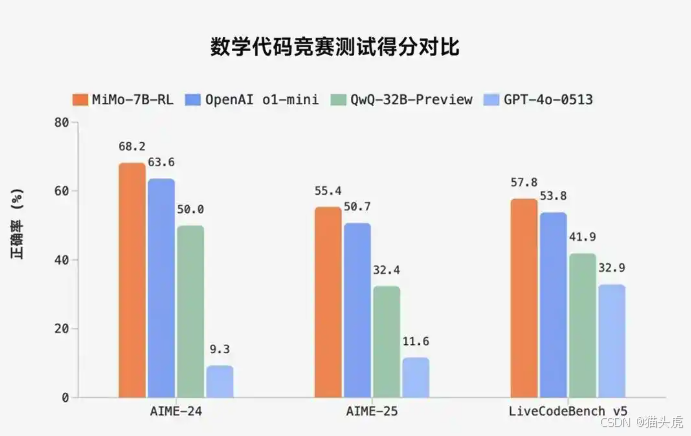

在大模型竞争愈发激烈的2025年4月30日,小米以一款名为 MiMo-7B 的开源模型强势突围,在数学推理与代码能力评测中表现亮眼,不仅与规模更大的模型正面对抗,甚至超越了 OpenAI 的 o1-mini 和 阿里的 QwQ-32B-Preview 等强敌。这一成绩,引发了业界的广泛关注。

技术破局:MiMo如何用7B挑战32B?

MiMo的惊艳表现,背后是一系列富有前瞻性的训练策略和工程创新:

1. 精准打磨的预训练阶段

MiMo并非凭参数“硬碰硬”,而是靠“巧劲”赢得优势。小米团队在预训练阶段精挑细选语料,聚焦推理、算法等高难度任务,并合成了2000亿 tokens 的推理数据。更重要的是,他们采用了“三阶段逐步提难”策略,使模型能够从浅层逻辑推理逐步过渡到复杂问题的解决。

最终,MiMo累计训练了 25万亿 tokens,这一数据在7B模型中堪称顶级,为其强悍能力打下坚实基础。

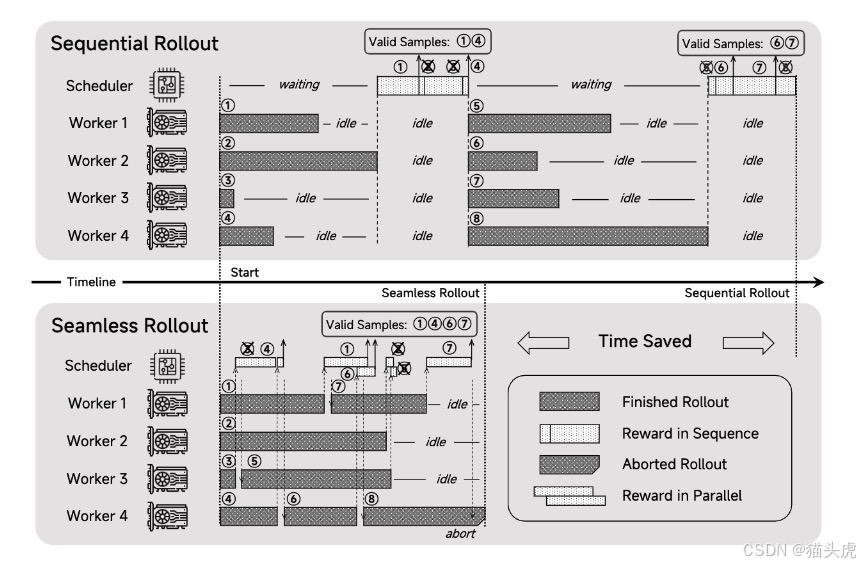

2. 创新的后训练机制

MiMo的强化学习阶段,也体现了极致的技术打磨:

- Test Difficulty Driven Reward 机制,有效解决了困难问题中“奖励稀疏”的困扰;

- Easy Data Re-Sampling 策略,提升了RL训练稳定性;

- 自研的 Seamless Rollout 系统,让强化训练速度提升 2.29倍,验证速度提升 1.96倍,大幅优化训练效率。

这些机制的结合,不仅让MiMo更“聪明”,也更“稳定”。

雷军“亲自上阵”:AI战略全面提速

MiMo并非偶然之作,而是小米AI战略升级的成果。据悉,小米正在建设 万卡级GPU集群,雷军亲自牵头项目推进。这不仅是资源投入的问题,更是战略决心的体现。

而在人才布局上,小米同样不惜重金。2024年底,95后AI大佬 罗福莉 加盟小米,以千万年薪领导大模型研发团队。她不仅是 DeepSeek-V2 的核心开发者,还推动了 MLA(Multi-head Latent Attention) 技术的发展,这项技术在降低大模型部署成本上发挥了关键作用。

AI赋能米家:从语音助手到数字管家

MiMo不是一个“独立秀场”,它正在成为小米智能生态的“大脑中枢”。

小爱同学未来将不仅仅听懂指令,而是真正理解用户的 意图与情绪。在MiMo的加持下:

- 空调 将根据睡眠模式智能调节风速;

- 厨房电器 能识别饮食偏好并给出建议;

- 电视 会根据家庭氛围个性化推荐内容。

这种从“命令执行”到“场景理解”的跃迁,不只是用户体验的提升,更为MiMo提供了大量真实、复杂的交互数据。这将反哺模型优化,形成闭环进化的AI生态试验田。

结语:小米的新角色,是AI生态的创变者

MiMo的发布,不仅标志着小米在大模型赛道的技术跃升,更意味着其正在从“智能终端制造商”迈向“AI生态运营者”。在模型、硬件、生态数据的三位一体加持下,小米未来的AI布局,值得持续关注。

MiMo项目链接:

模型开源地址

技术报告地址