【支持二次开发】基于YOLO系列的车辆行人检测 | 含完整源码、数据集、环境配置和训练教程

【支持二次开发】基于YOLO系列的车辆行人检测 | 含完整源码、数据集、环境配置和训练教程_哔哩哔哩_bilibili

系统能够自动显示目标总数、行人数目、车辆数目,实时计算并显示检测用时,性能优良

(创新点)可鼠标点击目标查看类型、置信度、位置坐标等详细信息

(创新点)采用onnx算子进行加速,提高实时检测的性能

可提供:

1.提供整理好的yolo格式的数据集

2.提供详细的训练和导出方法,可以使用自己的模型

3.实时视频,摄像头,图片检测

4.代码简洁,有注释

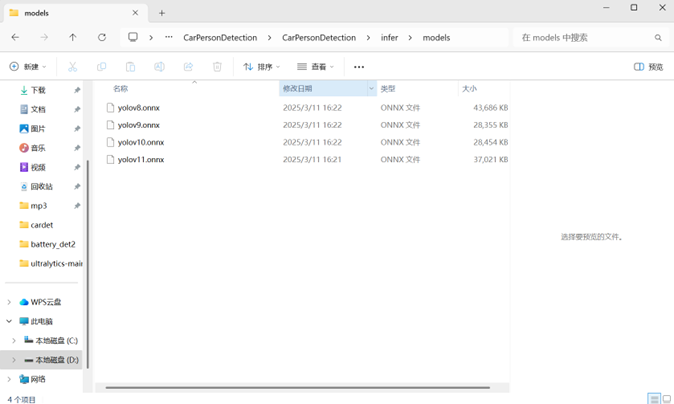

5.提供训练好的yolov8,v9,v10,v11等模型

获取源码、训练好的权重、数据集、说明文档:

https://m.tb.cn/h.6Yy0KLw?tk=BRFResuRxrW

训练自己的模型

- 前提说明:确保自己电脑有英伟达显卡来训练,否则使用CPU训练会很慢;确保自己电脑配置有anaconda,cuda,cudnn等深度学习基本环境。

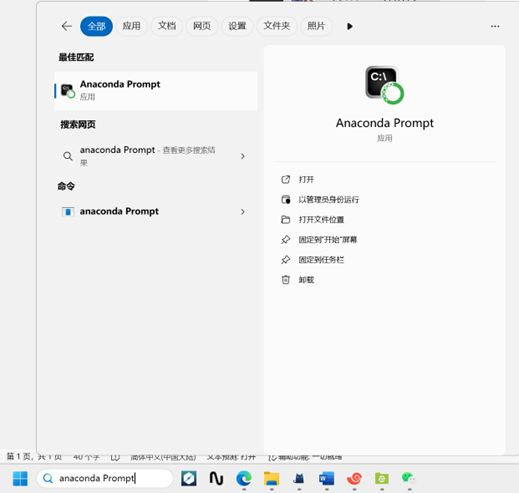

- 点击电脑左下角搜索框,搜索:Anaconda Prompt并打开

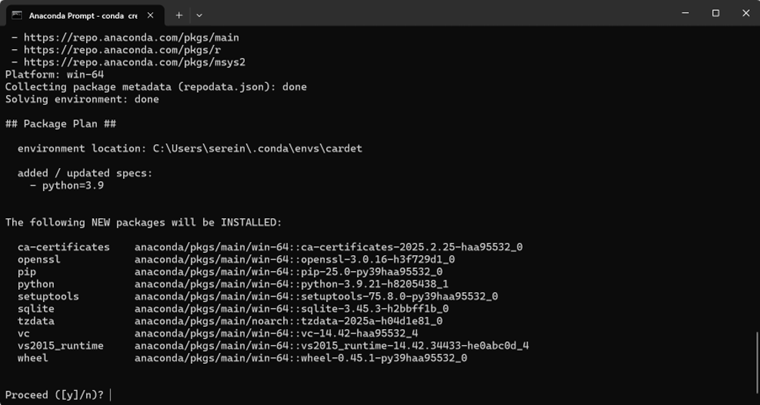

- 输入这条命令来创建一个新的虚拟环境,注意环境名称必须是全英文:

conda create -n 你的环境名 python=3.9

例如:

conda create -n cardet python=3.9

- 等待片刻,当出现如下内容时输入:y

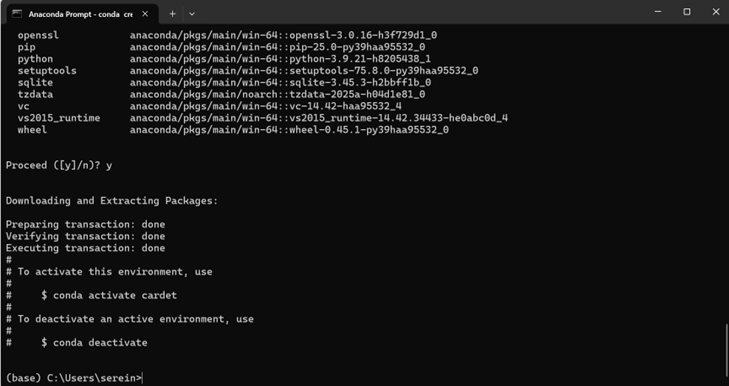

- 等待安装完成,当出现如下界面时说明环境创建成功:

- 接着输入以下命令来激活环境:

conda activate 你的环境名

例如:

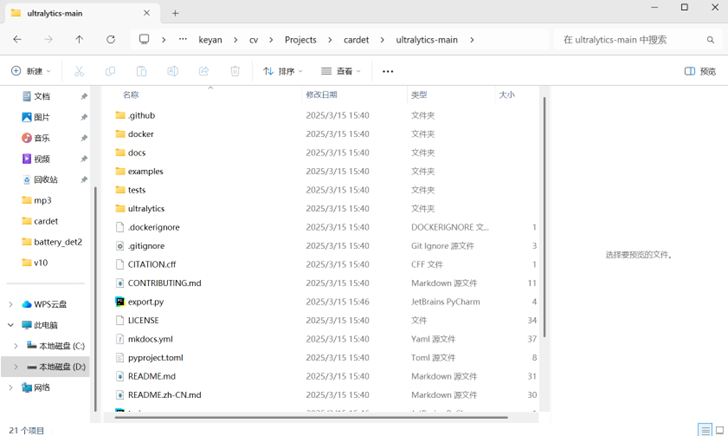

conda activate cardet - 解压你购买的源码压缩包,将其中ultralytics-main.zip压缩包解压至你的项目文件目录下,例如解压至D:\research\A_Vital\keyan\cv\Projects\cardet下:

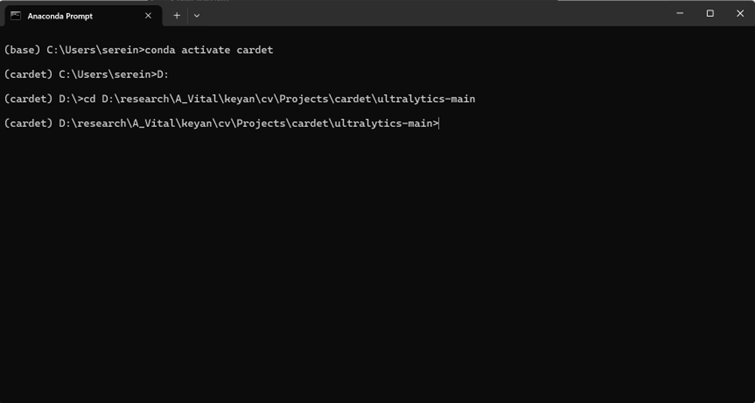

- 然后在anaconda prompt中输入以下命令切换至上述文件目录下:

首先输入以下命令切换至D盘:

D:

接着输入以下命令切换文件目录:

cd D:\research\A_Vital\keyan\cv\Projects\cardet\ultralytics-main

- 输入以下命令来配置环境:

pip install -r requirements.txt

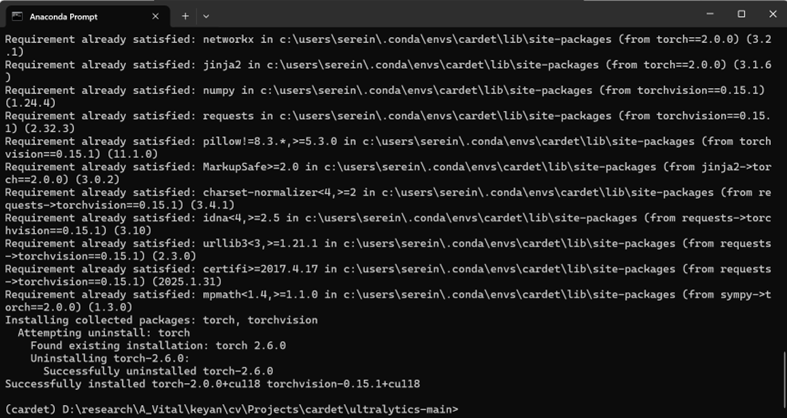

等待安装完成,接着输入以下命令安装pytroch和torchvision:

pip install torch==2.0.0 torchvision==0.15.1 --index-url https://download.pytorch.org/whl/cu118

等待安装完成,如果安装速度很慢,可能是没有使用国内镜像源,如何设置国内镜像源可参考:Anaconda 添加清华镜像源_conda添加清华源-CSDN博客

安装完成如下:

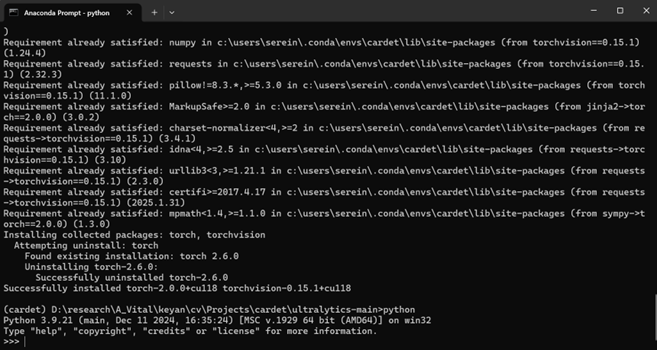

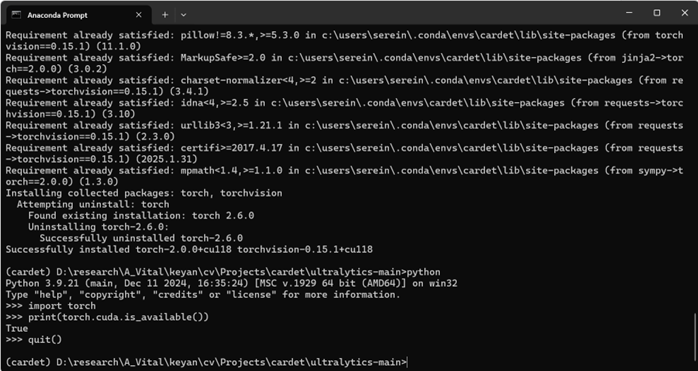

- 测试pytorch是否可用,输入以下命令:

python

接着输入以下代码,第一行代码输入完成后可能会卡一下,等待出现>>>后再输入下一行代码:

import torch

print(torch.cuda.is_available())

当出现True则说明环境没有问题,界面如下:

输入quit()退出python:

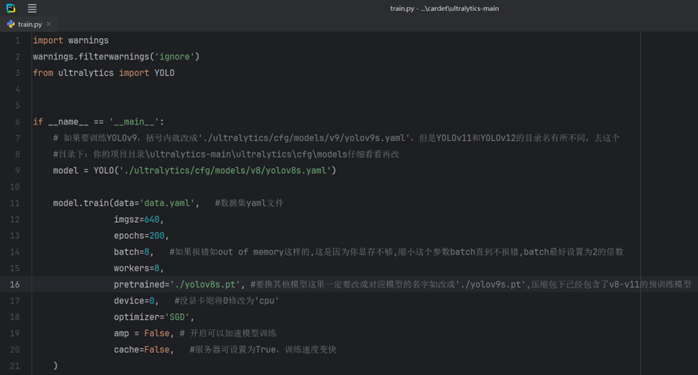

- 以训练YOLOv8为例,其他的YOLO系列也是一样的流程。在ultralytics-main文件夹下找到train.py文件:

点击打开并修改train.py文件如下:

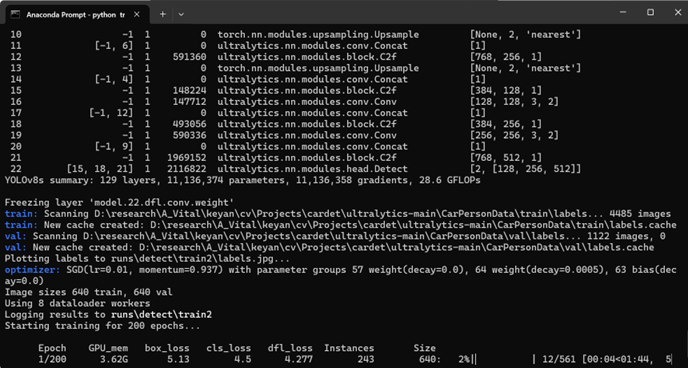

- 在anaconda prompt中输入以下命令开始训练:

python train.py

训练成功如下:

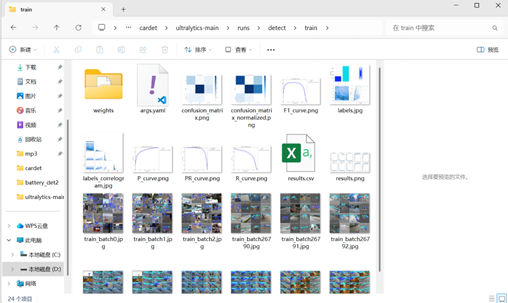

- 训练结果保存在:

你的项目目录\ultralytics-main\runs\detect\train

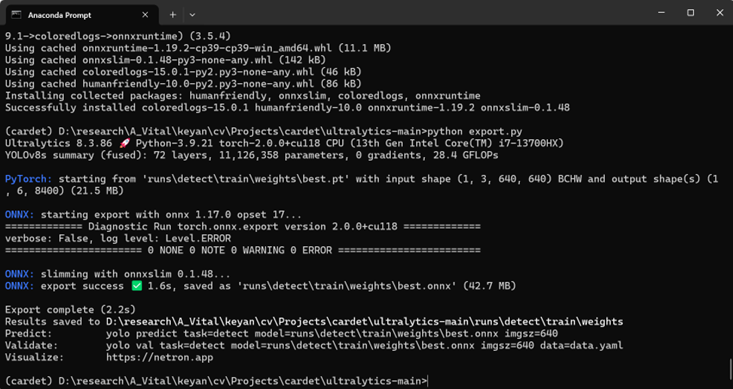

- 训练完成后,需要导出ONNX模型,在anaconda prompt中输入以下命令:

python export.py

导出成功如下:

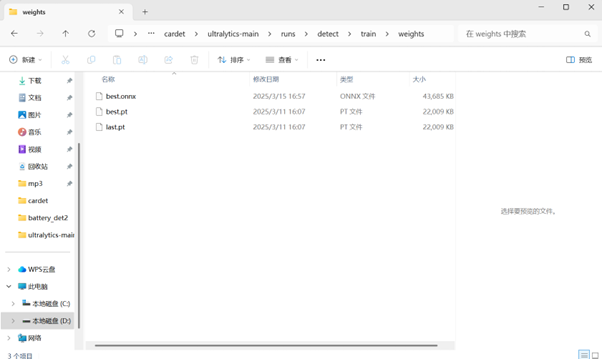

在你的项目目录\ ultralytics-main\runs\detect\train\weights下可以找到导出后的模型best.onnx:

- 将导出后的模型放在解压后的CarpersonDetection中的infer\models下即可,后面可以直接在系统使用该模型进行检测