注意力机制概念

1.向量余弦夹角

两个向量相乘,计算点积。

两个向量的方法越接近,余弦夹角趋向于0,点积越大,当两个向量垂直时,点积为0的,当两个项链方向相反时,点积为负数。

在语义空间中,两个词的向量约接近,这两个词就越相似。

2.反向传播

损失函数,衡量模型预测结果与真实标签之间差异,反向传播是基于链式法则的梯度计算算法,用于计算损失函数对网络中每个参数的偏导数,指导参数的优化更新,使损失函数逐步最小化。

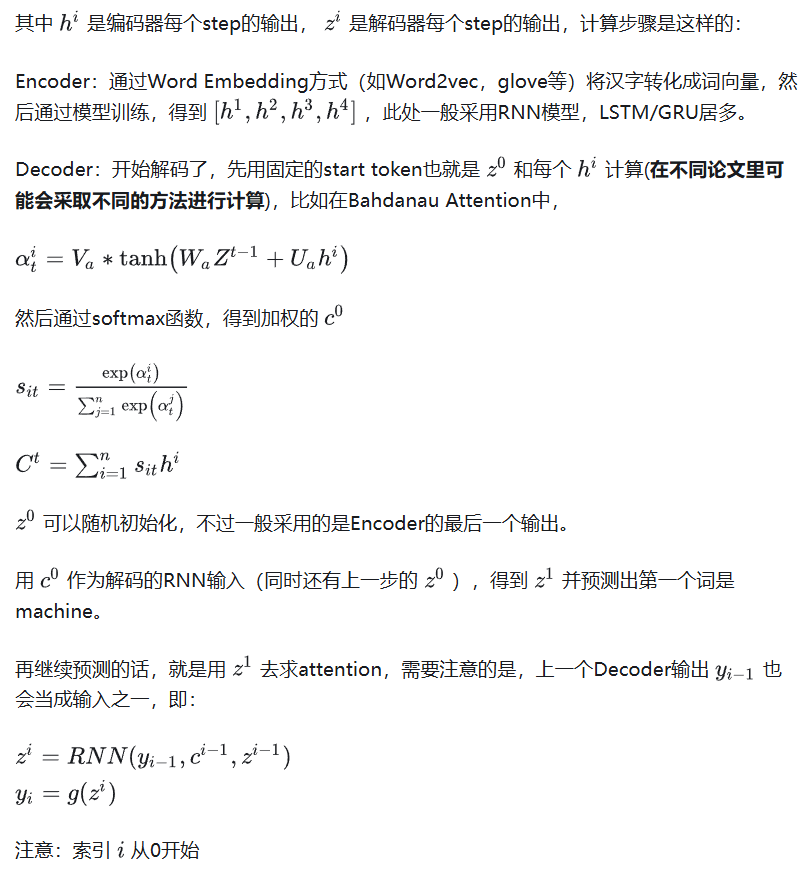

3.Transformer

文本输入-》词嵌入E;E+位置编码得到的项链通过学习得到q、k、v。

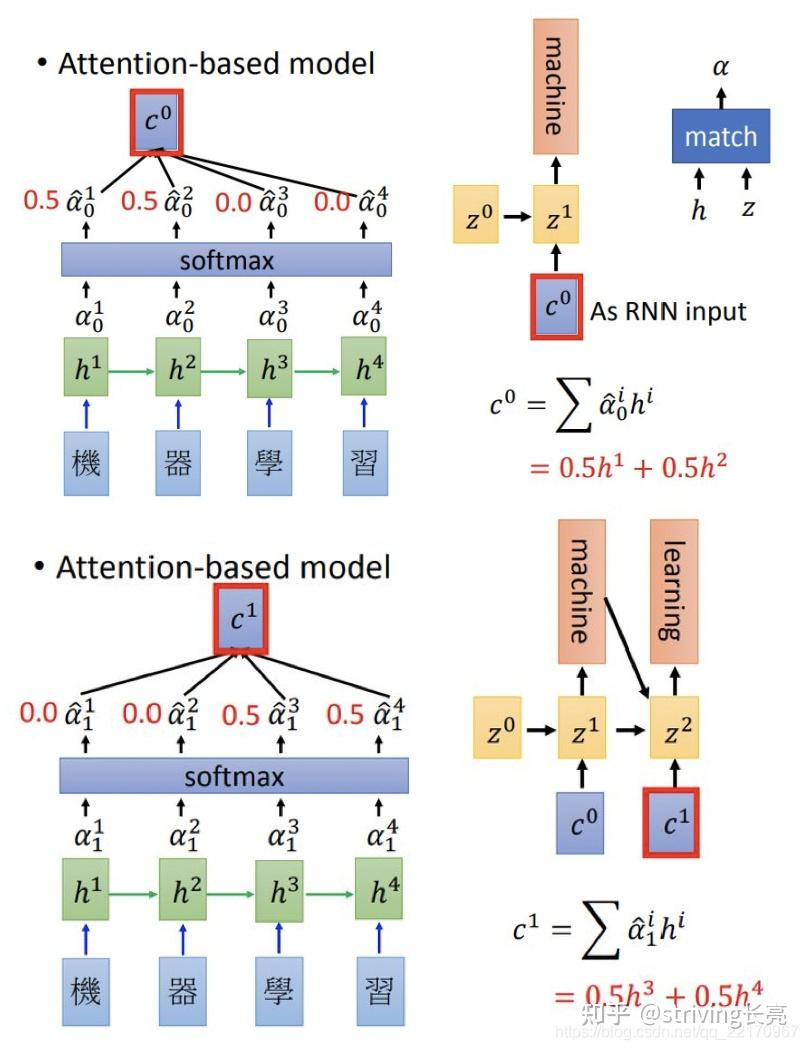

计算注意力:

是缩放因子。

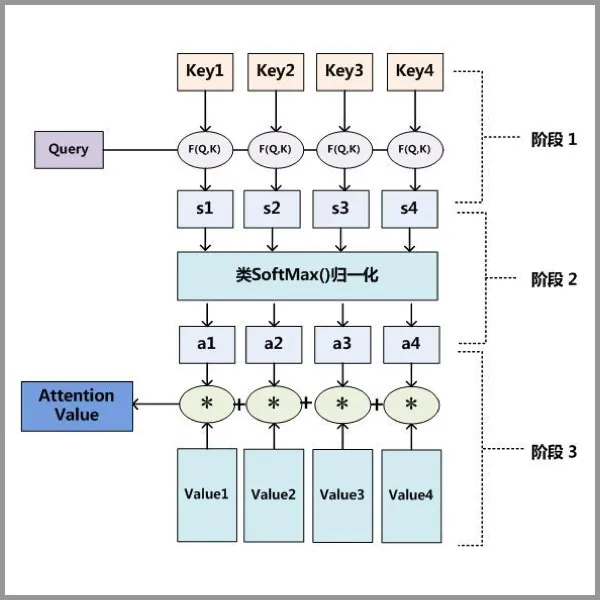

第一步: query 和 key 进行相似度计算,得到权值

第二步:将权值通过softmax进行归一化,得到每个key对应value的权重系数

第三步:将权重和 value 进行加权求和

Attention机制的本质是对source中元素的valye进行加权求和,query和key用来计算对应value的权重系数。

图片引自https://zhuanlan.zhihu.com/p/542312699