初始AI大模型-起源和发展

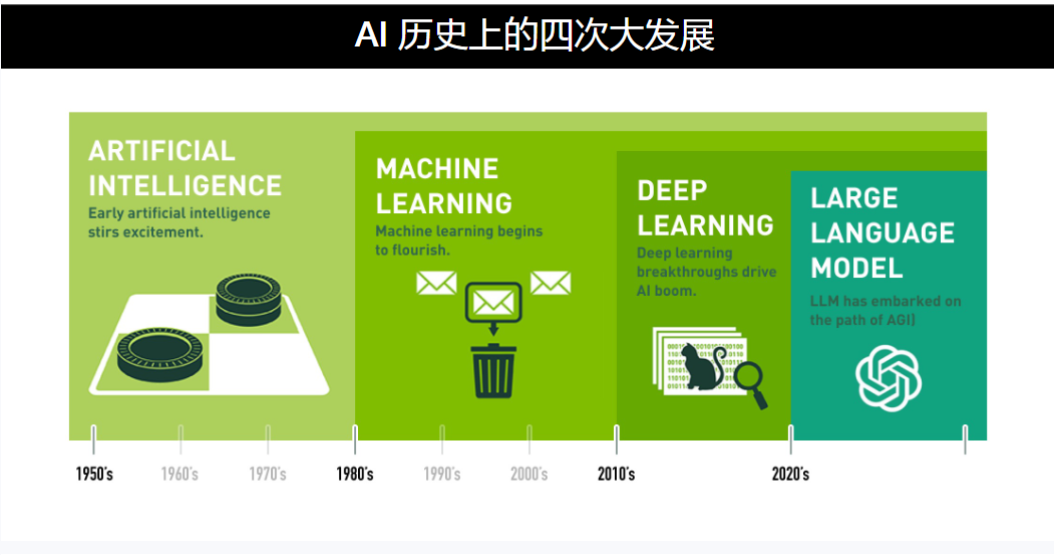

AI发展历史

解码注意力机制(Attention Mechanism)

什么事注意力机制

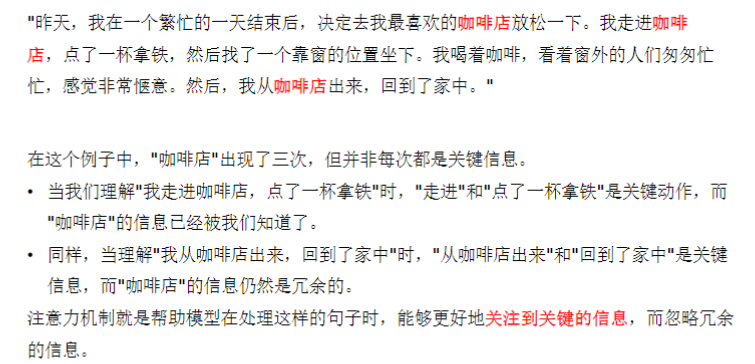

首先我们先看一段话

假设把我们当成一个智能体,我们去思考一个问题,我到底去了几次咖啡店?

可能在这段话当中,咖啡店出现了三次,会认为我们去了咖啡店三次,但是实际上我们需要了解一个关键点!!!

高频不等于重点

为什么要用注意力机制

为什么要用注意力机制

注意力机制的特点和优势

- 注意力机制有助于克服循环神经网络(RNNs)的一些挑战,例如输入序列长度增加时性能下降和顺序处理输入导致的计算效率低下。

- 在自然语言处理(NLP)、计算机视觉(Computer Vision)、跨模态任务和推荐系统等多个领域中,注意力机制已成为多项任务中的最先进模型,取得了显著的性能提升。

- 注意力机制不仅可以提高主要任务的性能,还具有其他优势。它们被广泛用于提高神经网络的可解释性,帮助解释模型的决策过程,使得原本被认为是黑盒模型的神经网络变得更易解释。这对于人们对机器学习模型的公平性、可追溯性和透明度的关注具有重要意义。

注意力机制能够对我们神经网络中一些不可解释的东西进行一些呈现

可以看上面那一幅图像,能够看到数字下面的图像,数字后面的图像就是通过神经网络所学到的东西。

如何实现注意力机制

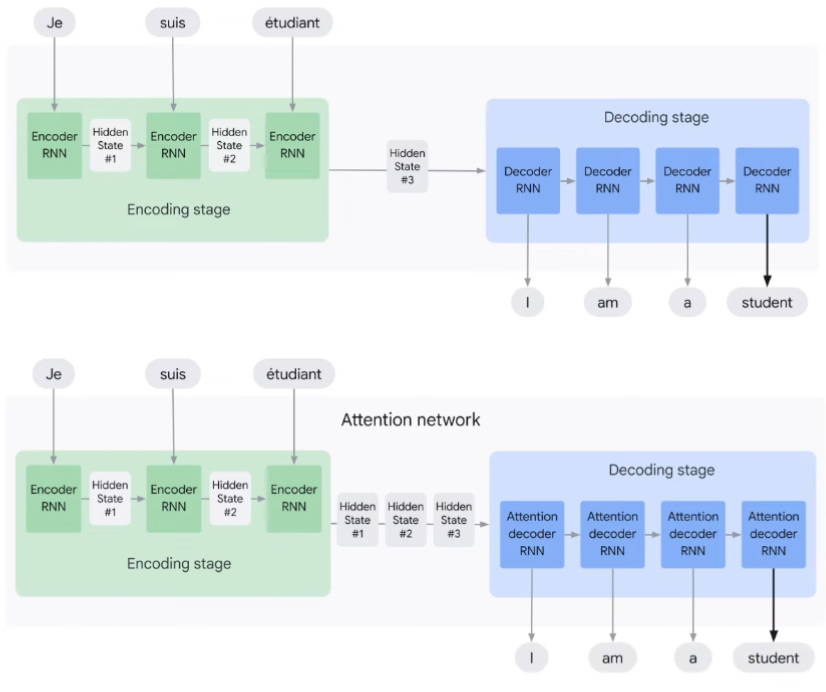

上面那个模型是没有引入注意力机制的模型,下方是引入了注意力机制的模型,可以总体总结,引入注意力机制的模型使用了一种数学方法,将Hidden State#1、Hidden State#2、Hidden State#3的信息共同传到解码器的阶段。

传统编码器 - 解码器

编码阶段,通过函数 \(h_i = f(x_i, h_{i - 1})\) 计算编码器隐藏状态 \(h_i\) ,\(x_i\) 是输入序列元素,\(h_{i - 1}\) 是前一时刻隐藏状态。