Token Activation Map to Visually Explain Multimodal LLMs

1. BaseInfo

| Title | Token Activation Map to Visually Explain Multimodal LLMs |

| Adress | https://arxiv.org/pdf/2506.23270 |

| Journal/Time | ICCV25 Oral |

| Author | 港科大 |

| Code | https://github.com/xmed-lab/TAM |

2. Creative Q&A

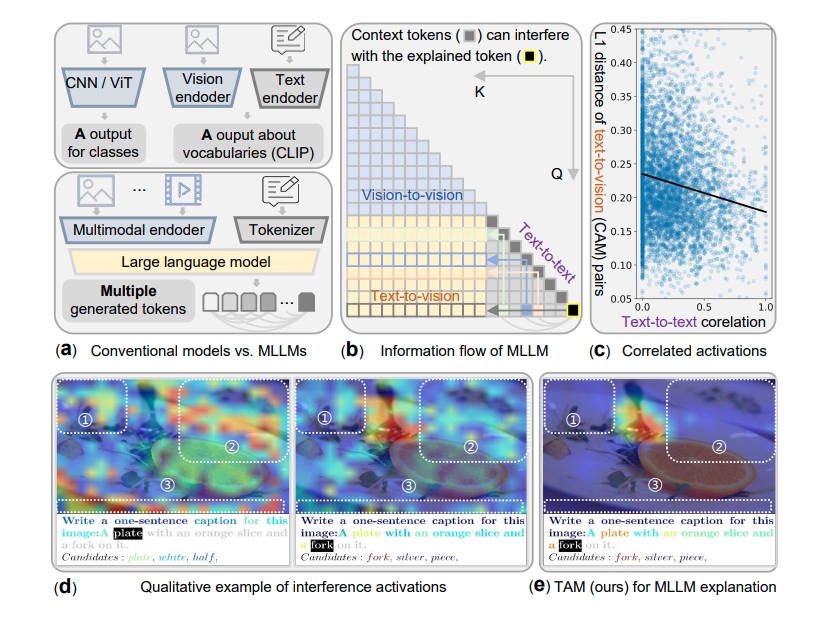

传统的可视化方法,比如CAM ,它们是为CNN或ViT设计的,这些模型通常只有一个输出(比如“猫”或“狗”)。

但MLLMs不一样,它们是逐个生成Token(也就是词)的。“A… plate… with… a… fork…”

上下文干扰 (Context Interference):当模型生成 “fork”(叉子)这个词时,它脑子里还记着前面刚说过的 “plate”(盘子)。你如果用老方法去解释 “fork”,会发现模型不仅在看叉子,它同时还在看盘子。

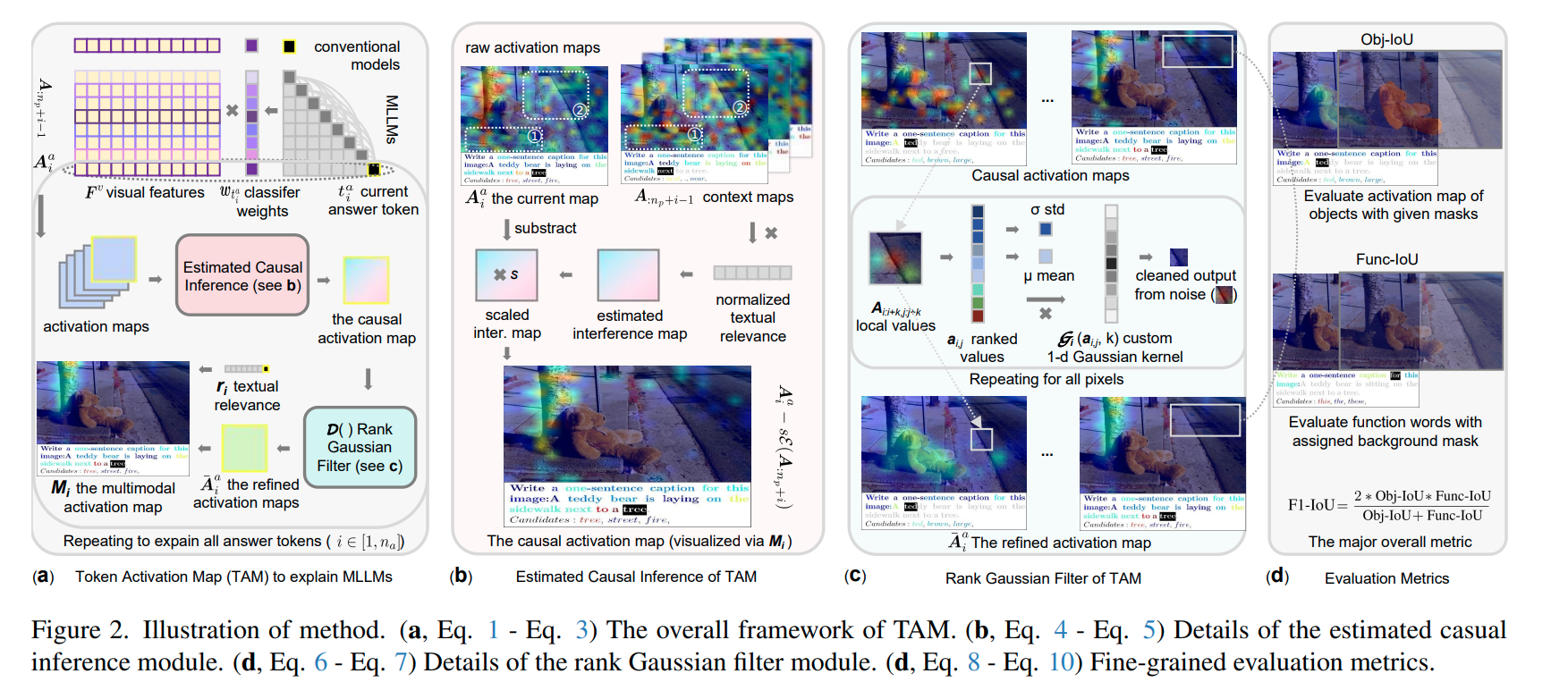

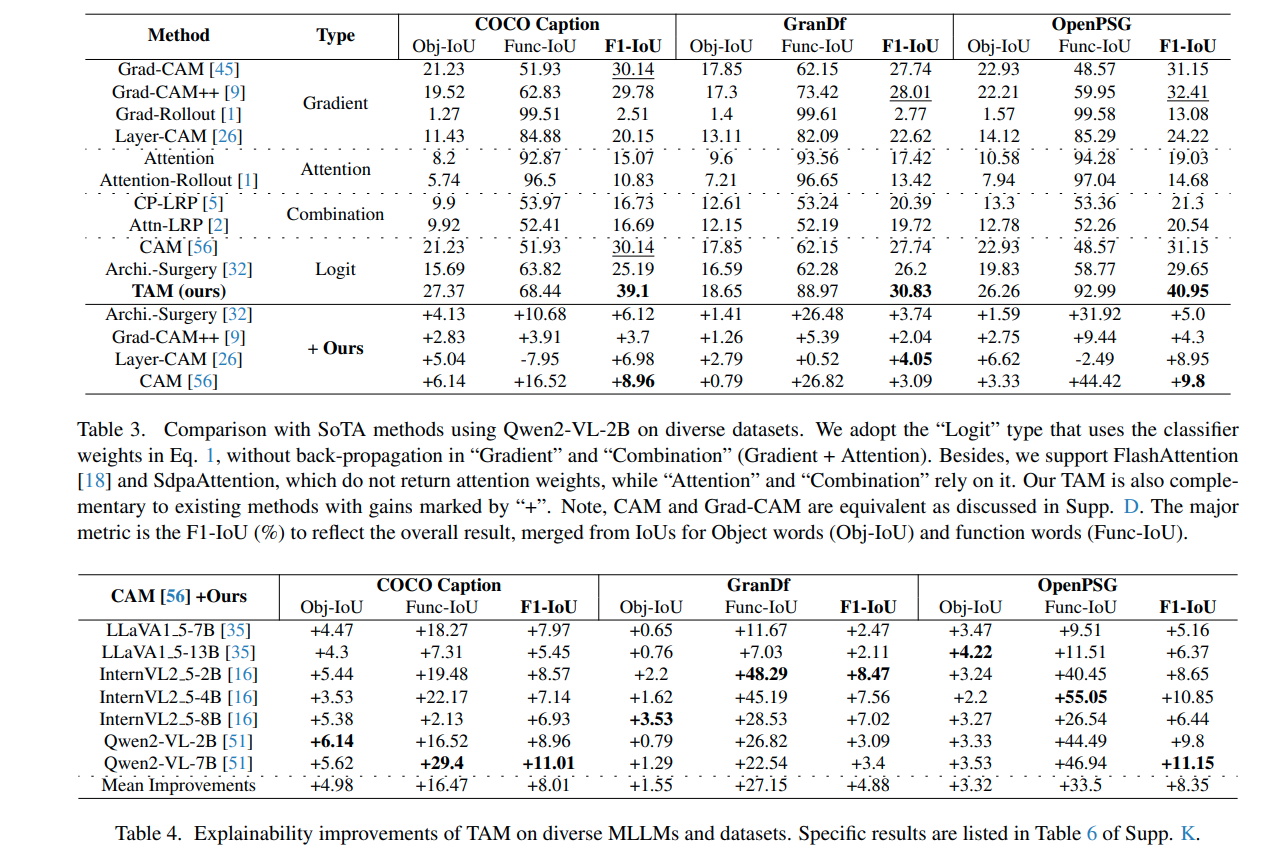

现有的可视化方法,如CAM 和 Grad-CAM ,主要被设计用于解释具有单一预测输出的传统视觉模型 。然而,当直接应用于多模态大模型(MLLMs)时,这些方法会面临独特的挑战,因为MLLMs是逐个渐进式地 (progressively) 生成Token序列的 。这种生成方式导致了显著的上下文干扰 (context interference) 问题,即先前生成的Token(例如 ‘plate’)的激活会不必要地干扰(或‘泄露’到)后续Token(例如 ‘fork’)的视觉解释中。TAM的核心是一种估计因果推断 (estimated causal inference) 机制 ,它通过估计并主动移除(减去)来自上下文Token的冗余激活 ,从而分离出专属于当前目标Token的视觉归因。此外,该方法还集成了一个排序高斯滤波器 (rank Gaussian filter) 以提高激活图的质量并减少噪声

(1) 估计因果推断 (Estimated Causal Inference):如何把之前的部分减掉,得到仅关于这层的激活图:

首先,计算当前要解释的词(比如 “fork”)和所有之前的词(比如 “A”, “plate”, “with”)在文本上的相关性 。

然后,把这些前面词的视觉激活图(“plate” 的图,“with” 的图…)根据文本相关性加权平均,得到一张“总干扰图” 。

最后,用一个通过最小二乘法优化出的最佳缩放比例 sss ,从 “fork” 的原始激活图中,减掉这张“总干扰图” 。

这样“减法”做完,剩下的就是真正只由 “fork” 这一个词引起的视觉激活 。作者认为这更接近一种“因果关系”,而不是简单的相关性。

核心是基于文本相关性 对视觉激活图进行加权相减 。

(2)排序高斯滤波器 (Rank Gaussian Filter): 解决了干扰问题后,我们还发现Transformer的激活图本身就有很多“噪声”(salt-and-pepper noise) : 设计了一个新的滤波器 。它不像普通高斯滤波那样简单地平滑,也不像中值滤波那样粗暴 。它是在一个窗口内,先把所有激活值排序,然后给一个以中位数为中心的高斯权重来进行加权求和 。这能非常干净地去除噪声,同时保留重要的高光区域.

3. Concrete

设计了新指标:

Obj-IoU:看物体词(比如 “fork”)的激活图和它的真值Mask重合度高不高 。

Func-IoU:看功能词(比如 “is”, “the”, “a”)的激活图 。这些词不应该在图上激活,所以我们看它保持“沉默”(即激活在背景)的能力强不强 (该指标假设功能词(如 “is”, “the”)不应具有视觉激活 。)

F1-IoU:把上面两个结合起来,得到一个总分

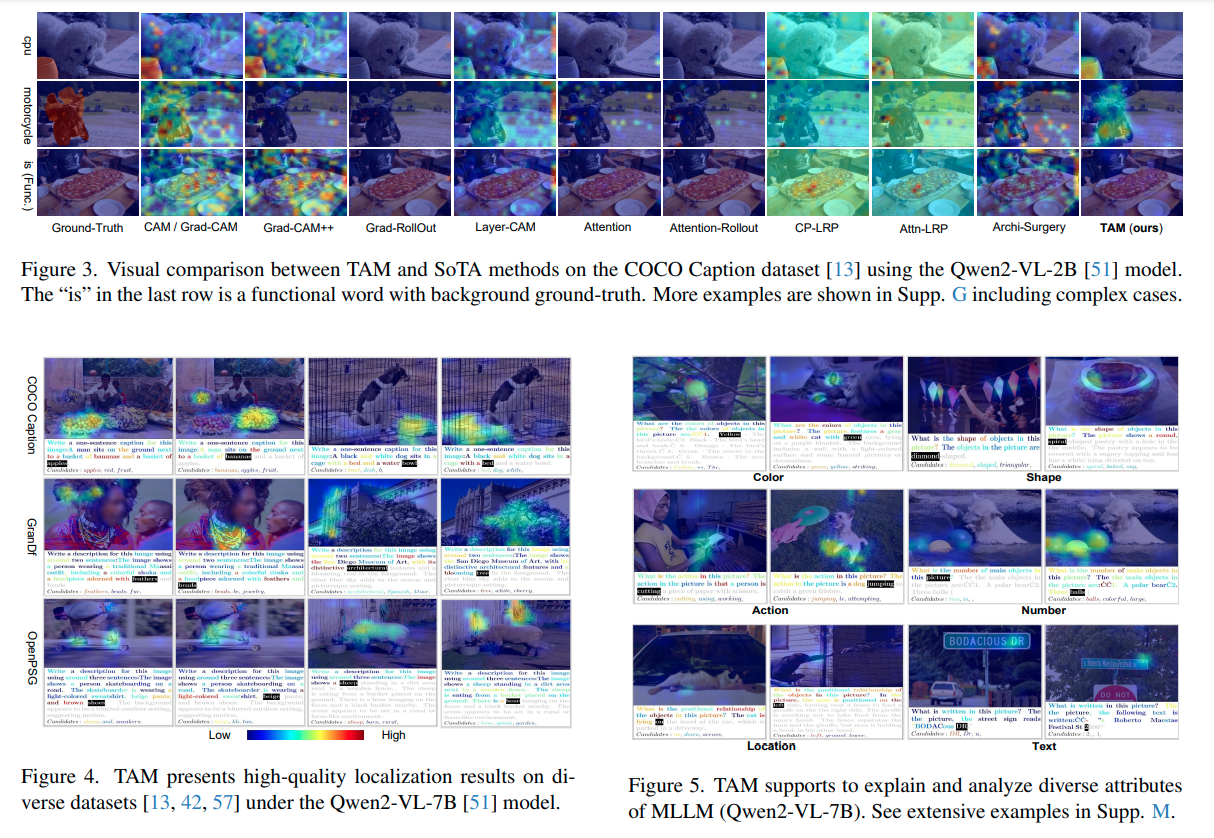

分析失败案例:可以用TAM去看模型到底“看错了”哪里,是没看到,还是和上下文搞混了

可视化对比MLLM:可以直观对比Qwen-VL和LLaVA哪个模型的图文对齐能力更强

解释新能力:它还能解释视频 、多轮对话 和多图输入 。

TAM是第一个专为MLLM的渐进式生成特性而设计的解释方法,它通过因果推断解决了上下文干扰这个核心问题。

4. EXP

5. Additional

最近的工作就是用的 GradCAM 遇到了到之后叠加的问题,第一层还能看到关注的区域,到后面发现都被关注到了,因为是递进的,也不知道是后面层关注到的是什么。