OpenCV 风格迁移、DNN模块 案例解析及实现

图像风格迁移是计算机视觉领域极具趣味性的技术之一 —— 它能将普通照片(内容图像)与艺术画作(风格图像)的特征融合,生成兼具 “内容轮廓” 与 “艺术风格” 的新图像。OpenCV 的 DNN(深度神经网络)模块为风格迁移提供了轻量、便捷的实现方案,无需搭建复杂的深度学习框架,仅通过加载预训练模型即可快速完成风格迁移。本文将从基础概念入手,详解 DNN 模块特性,最终通过完整案例实现 “照片转梵高星空风”“照片转糖果风” 等效果。

一、核心概念:风格迁移与 OpenCV DNN 模块

在动手写代码前,我们需要先理清两个关键概念:风格迁移的原理和OpenCV DNN 模块的定位,这是理解后续实战的基础。

1. 什么是图像风格迁移?

图像风格迁移的核心目标是 “内容与风格的分离与重组”:

- 内容图像:提供图像的 “结构信息”,比如照片中的建筑、人物、风景轮廓(例:黄鹤楼照片)。

- 风格图像:提供图像的 “艺术风格信息”,比如梵高《星空》的漩涡笔触、莫奈《睡莲》的色彩晕染(例:梵高《星空》)。

- 生成图像:保留内容图像的结构,同时赋予风格图像的艺术特征(例:“梵高星空风” 的黄鹤楼)。

在 OpenCV 中,风格迁移的实现依赖预训练的神经网络模型—— 这些模型已通过大量 “内容 - 风格” 图像对训练完成,能自动学习 “如何提取内容特征”“如何迁移风格特征”,我们只需加载模型并传入内容图像即可生成结果。

2. OpenCV DNN 模块:轻量的深度学习推理工具

DNN(Deep Neural Networks)是 OpenCV 中专门用于深度学习模型推理的模块,它不负责模型训练,仅专注于 “加载已训练模型并完成预测”,这使其具备以下核心优势:

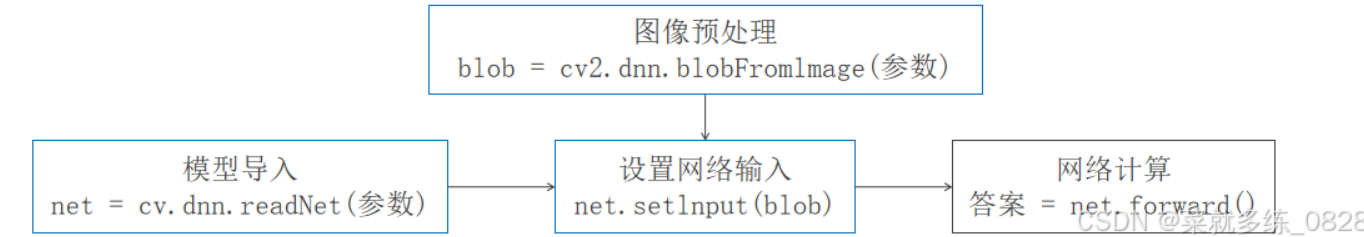

DNN 模块实现风格迁移的核心流程可概括为:

加载预训练风格模型 → 内容图像预处理 → 模型推理(风格迁移) → 输出结果后处理 → 显示/保存生成图像

二、关键技术:图像预处理与模型加载

风格迁移的效果好坏,除了依赖预训练模型,还与 “图像预处理” 和 “模型加载方式” 密切相关。下面详解这两个关键步骤的技术细节。

1. 图像预处理:让图像符合模型输入要求

深度学习模型对输入图像的格式有严格要求(如尺寸、通道顺序、数据范围),而 OpenCV 读取的原始图像(BGR 格式、像素值 0-255)通常无法直接传入模型,需要通过 **cv2.dnn.blobFromImage()** 函数进行预处理,将其转换为模型可识别的 “四维 Blob 数据”(格式:N×C×H×W,其中 N = 批量大小、C = 通道数、H = 高度、W = 宽度)。

cv2.dnn.blobFromImage()参数详解

该函数是 DNN 模块的 “预处理核心”,支持缩放、裁剪、通道转换、均值减法等操作,参数如下:

辅助工具:自动缩放图像函数

若原始图像尺寸过大(如 4K 照片),会导致模型推理速度慢且占用内存高。可自定义一个 “自动缩放函数”,按指定宽度 / 高度缩放图像,同时保持纵横比不变:

import cv2def auto_resize(image, width=None, height=None, inter=cv2.INTER_AREA):"""自动缩放图像(保持纵横比):param image: 输入原始图像:param width: 目标宽度(若为None,则按height缩放):param height: 目标高度(若为None,则按width缩放):param inter: 插值方式(cv2.INTER_AREA适合缩小,cv2.INTER_CUBIC适合放大):return: 缩放后的图像"""# 获取原始图像尺寸(h, w) = image.shape[:2]# 若未指定宽度和高度,返回原图if width is None and height is None:return image# 若仅指定高度,按高度比例计算宽度if width is None:ratio = height / float(h)dim = (int(w * ratio), height)# 若仅指定宽度,按宽度比例计算高度else:ratio = width / float(w)dim = (width, int(h * ratio))# 执行缩放并返回结果resized = cv2.resize(image, dim, interpolation=inter)return resized2. 模型加载:两种常用函数对比

OpenCV DNN 模块提供两种加载风格模型的函数,需根据模型格式选择:cv2.dnn.readNet()(通用)和 **cv2.dnn.readNetFromTorch()**(专门用于 Torch 格式模型)。

(1)cv2.dnn.readNetFromTorch():Torch 模型专用

风格迁移的预训练模型多为 Torch7 格式(文件后缀.t7),该格式模型将 “架构” 和 “权重” 存储在同一个文件中,加载时只需传入文件路径:

# 加载梵高星空风格模型(.t7格式)

net = cv2.dnn.readNetFromTorch("models/starry_night.t7")(2)cv2.dnn.readNet():多格式通用

若模型为 Caffe(需.prototxt架构文件 + .caffemodel权重文件)、TensorFlow(.pb文件)等格式,需用该函数,根据格式传入不同参数:

# 加载Caffe格式模型(需架构文件+权重文件)

net = cv2.dnn.readNet(model="models/style.caffemodel", config="models/style.prototxt")# 加载Torch格式模型(与readNetFromTorch效果一致)

net = cv2.dnn.readNet(model="models/starry_night.t7") # 仅需传入模型文件

三、完整实战:实现多风格迁移

下面通过完整代码,实现 “加载不同风格模型 → 预处理图像 → 推理生成 → 显示结果” 的全流程。我们以 “黄鹤楼照片” 为内容图像,分别迁移 “梵高星空风” 和 “糖果风”。

1. 前期准备

- 环境搭建:安装 OpenCV(

pip install opencv-python)。 - 模型下载:下载上述推荐的

.t7格式风格模型,放在models文件夹中(与代码同级目录)。 - 内容图像:准备一张内容图像(如

huanghelou.jpg),放在代码同级目录。

2. 完整代码(支持切换风格模型)

import cv2def auto_resize(image, width=None, height=None, inter=cv2.INTER_AREA):"""自动缩放图像(保持纵横比)"""(h, w) = image.shape[:2]if width is None and height is None:return imageif width is None:ratio = height / float(h)dim = (int(w * ratio), height)else:ratio = width / float(w)dim = (width, int(h * ratio))resized = cv2.resize(image, dim, interpolation=inter)return resizeddef style_transfer(content_img_path, model_path, target_width=600):"""图像风格迁移核心函数:param content_img_path: 内容图像路径:param model_path: 风格模型路径(.t7格式):param target_width: 内容图像目标宽度(默认600px,平衡速度与效果):return: 风格迁移后的图像"""# 1. 读取并预处理内容图像content_img = cv2.imread(content_img_path)if content_img is None:raise ValueError(f"无法读取内容图像,请检查路径:{content_img_path}")# 自动缩放图像(避免尺寸过大导致推理缓慢)content_img_resized = auto_resize(content_img, width=target_width)(h, w) = content_img_resized.shape[:2] # 获取缩放后图像尺寸# 2. 图像预处理:转换为DNN模型可识别的Blob格式# 参数说明:缩放因子1.0,尺寸(w,h),均值(0,0,0),交换BGR→RGB,不裁剪blob = cv2.dnn.blobFromImage(image=content_img_resized,scalefactor=1.0,size=(w, h),mean=(0, 0, 0),swapRB=True,crop=False)# 3. 加载风格模型并执行推理print(f"正在加载风格模型:{model_path}")net = cv2.dnn.readNetFromTorch(model_path)net.setInput(blob) # 将预处理后的Blob传入模型output = net.forward() # 执行前向传播,得到风格迁移结果(四维Blob:1×3×h×w)# 4. 输出结果后处理(将四维Blob转换为OpenCV可显示的图像格式)# 步骤1:重塑维度(去掉批量维度,变为3×h×w)output_reshaped = output.reshape((3, h, w))# 步骤2:归一化(将像素值映射到0-1范围,避免数值溢出)cv2.normalize(output_reshaped, output_reshaped, norm_type=cv2.NORM_MINMAX)# 步骤3:转置维度(从C×H×W转为H×W×C,符合OpenCV图像格式)output_img = output_reshaped.transpose((1, 2, 0))# 步骤4:将像素值从0-1映射到0-255(OpenCV显示需8位整数)output_img = (output_img * 255).astype("uint8")# 5. 显示结果cv2.imshow("原始内容图像", content_img_resized)cv2.imshow("风格迁移结果", output_img)print("按下ESC键关闭窗口")# 等待ESC键(27为ESC的ASCII码),关闭窗口后释放资源while cv2.waitKey(1) != 27:continuecv2.destroyAllWindows()return output_img# ------------------- 主程序:切换不同风格模型 -------------------

if __name__ == "__main__":# 内容图像路径(请根据实际情况修改)content_image_path = "huanghelou.jpg"# 风格模型路径(可切换不同模型实现不同风格)style_models = {"梵高星空风": "models/starry_night.t7","糖果风": "models/candy.t7","文艺复兴风": "models/la_muse.t7","呐喊风": "models/the_scream.t7"}# 选择一种风格执行迁移(例如:梵高星空风)selected_style = "梵高星空风"style_model_path = style_models[selected_style]# 执行风格迁移print(f"开始执行{selected_style}迁移...")result_img = style_transfer(content_image_path, style_model_path)# (可选)保存结果图像save_path = f"huanghelou_{selected_style}.jpg"cv2.imwrite(save_path, result_img)print(f"结果图像已保存至:{save_path}")

3. 代码说明与效果验证

(1)核心流程拆解

- 图像缩放:通过

auto_resize()将内容图像缩放到宽度 600px,平衡推理速度与视觉效果。 - Blob 转换:

cv2.dnn.blobFromImage()将 BGR 图像转为 RGB 格式的四维 Blob,符合模型输入要求。 - 模型推理:加载

.t7模型后,通过net.setInput(blob)和net.forward()完成风格迁移。 - 结果后处理:通过重塑维度、归一化、转置,将模型输出的四维 Blob 转为 OpenCV 可显示的 8 位图像。

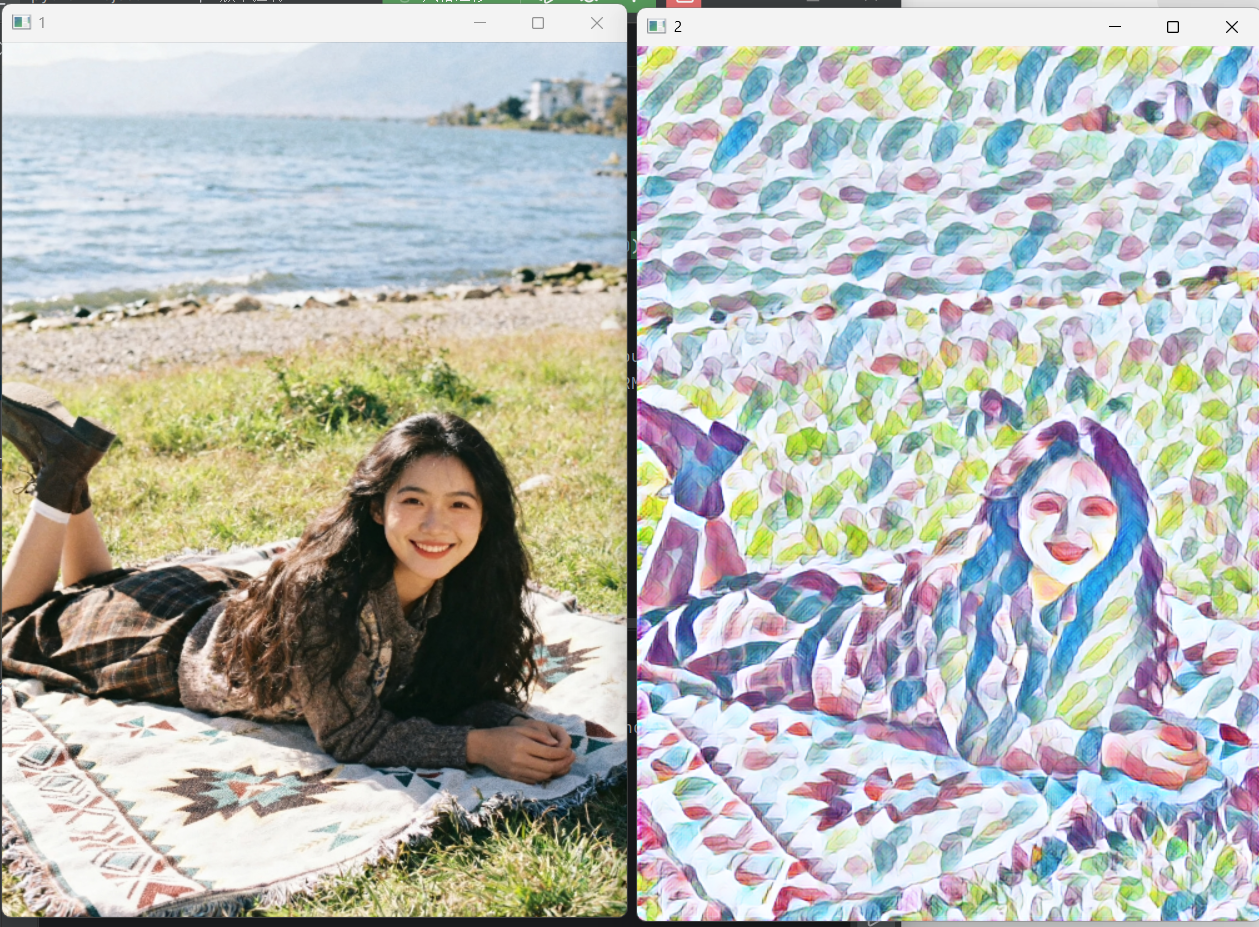

(2)效果验证

- 运行代码后,会弹出两个窗口:“原始内容图像” 和 “风格迁移结果”。

- 按下 ESC 键关闭窗口后,结果图像会自动保存为

huanghelou_梵高星空风.jpg(或对应风格名称)。 - 切换风格时,只需修改

selected_style变量(如改为 “糖果风”),即可生成不同艺术风格的图像。

4. 常见问题与解决方案

四、总结与扩展

本文通过 “概念→技术→实战” 的流程,详解了 OpenCV DNN 模块实现风格迁移的完整方案:

- 核心优势:无需依赖重型深度学习框架,仅用 OpenCV 即可快速实现风格迁移,适合轻量级部署。

- 关键技术:

cv2.dnn.blobFromImage()预处理、cv2.dnn.readNetFromTorch()加载模型、结果维度转换与归一化。 - 实战价值:支持切换多种风格模型,可应用于图像美化、文创设计、短视频特效等场景。

扩展方向

- 批量风格迁移:遍历文件夹中的所有图像,批量生成指定风格的结果(需添加文件遍历逻辑)。

- 实时摄像头风格迁移:调用电脑摄像头,实时捕捉画面并应用风格迁移(类似案例 2 的摄像头检测逻辑,将每一帧传入模型)。

- 模型优化:对于嵌入式设备()