机器学习笔记:集成学习/模型融合

1 介绍

- 集成学习是指结合两个或多个模型的机器学习模型

- 通常情况下,集成学习能比单个模型找到更好的性能。

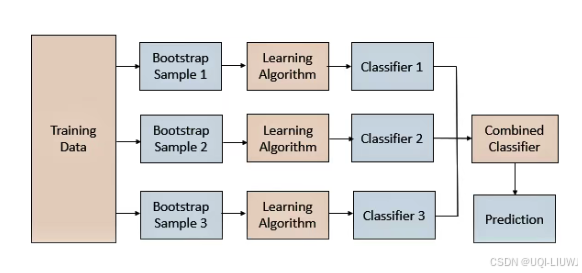

2 Bagging

Bagging通过采样训练数据集的样本,训练得到多样的模型,进而得到多样的预测结果- 在结合模型的预测结果时,可以对单个模型预测结果进行投票或平均。

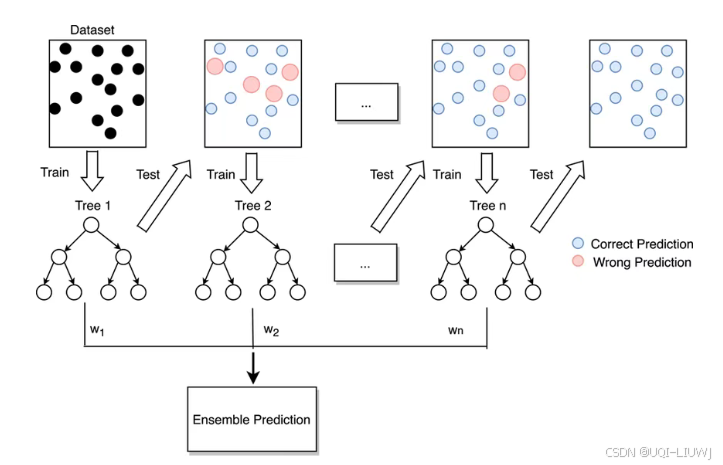

2.1 随机森林

随机森林是 Bagging与树模型的结合:

-

随机森林集成在训练数据集的不同引导样本上拟合决策树。

-

随机森林还将对每个数据集的特征(列)进行采样

-

在构建每个决策树时,随机森林不是在选择分割点时考虑所有特征,而是将特征限制为特征的随机子集。

3 Boosting

Boosting在迭代过程中尝试纠先前模型所产生的错误,迭代次数越多集成产生的错误就越少

4 voting

Voting使用简单的统计数据来组合来自多个模型的预测。

-

硬投票:对预测类别进行投票;

-

软投票:对预测概率进行求均值;

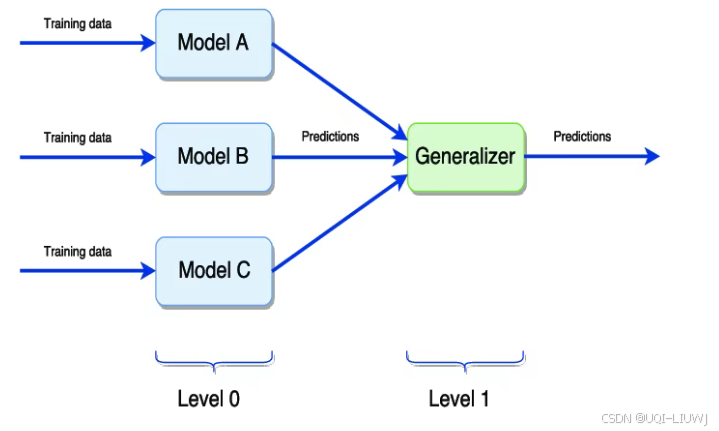

5 Stacking

Stacking组合多种不同类型的基本模型的预测,和Voting类似。- 但

Stacking可以根据验证集来调整每个模型的权重。

参考内容 机器学习模型融合大法!